Nvidiaが$26 Billion規模のオープンモデル AI投資の一環としてNemotron 3 Superを発表—米国版Qwenの答えとなるか?

要点

- Nvidiaは、自律エージェントや超長文脈タスクに最適化された1200億パラメータのオープンウェイトAIモデル「Nemotron 3 Super」を発表しました。

- ハイブリッドのMamba-Transformer MoEアーキテクチャにより、推論速度が向上し、4ビット精度で動作しながらスループットは5倍以上に達します。

- Nvidiaの260億ドルのオープンソースAIへの投資は、中国の台頭に対抗する狙いがあります。

Nvidiaは、Nemotron 3 Superをリリースしました。これは、計算コストを抑えつつ自律AIエージェントを効率的に動作させるために設計された、1200億パラメータのオープンウェイトモデルです。 これは小さな問題ではありません。マルチエージェントシステムは、通常のチャットよりもはるかに多くのトークンを生成します。ツール呼び出し、推論ステップ、コンテキストの断片ごとに再送信されるため、コストが爆発的に増加し、モデルのドリフトや精度低下を引き起こします。 Nemotron 3 Superは、これらの課題に対するNvidiaの解答です。モデルは1200億のうち120億のアクティブパラメータを持ち、エキスパート混合(MoE)設計を採用して推論コストを抑えつつ、複雑なワークフローに必要な推論深度を維持します。1百万トークンのコンテキストウィンドウを備え、エージェントはコードベース全体や約75万語をメモリに保持したまま処理できます。

モデル構築には、長いトークンストリームの処理に優れた高速かつメモリ効率の良いMamba-2ステートスペース層、正確なリコールを可能にするTransformerの注意層、そしてトークン埋め込みを圧縮してエキスパートにルーティングする新しい「Latent MoE」設計の3つの要素を組み合わせました。これにより、同じ計算コストで4倍のスペシャリストを活性化できます。

NVIDIA Nemotron 3 Super 🎉

オープン120Bパラメータ(12Bアクティブ)ハイブリッドMamba-Transformer MoEモデル

ネイティブ1Mトークンのコンテキスト

高精度かつ計算効率の良いマルチエージェントアプリケーション向けに設計

さらに、完全オープンのウェイト、データセット、レシピにより簡単にカスタマイズ可能… pic.twitter.com/kMFI23noFc

— NVIDIA AI Developer (@NVIDIAAIDev) 2026年3月11日

このモデルは、Nvidiaの4ビット浮動小数点フォーマットNVFP4で事前学習も行われています。実際には、最初の勾配更新から正確に4ビット演算内で動作できるよう学習されており、高精度で訓練した後に圧縮する従来の方法と異なり、精度低下を防ぎます。 参考までに、モデルの精度はビット数で測定されます。FP32と呼ばれるフル精度は最も標準的ですが、スケールでの運用は非常にコストがかかります。開発者は、計算コストを節約しつつ有用な性能を維持するために、しばしば精度を下げます。

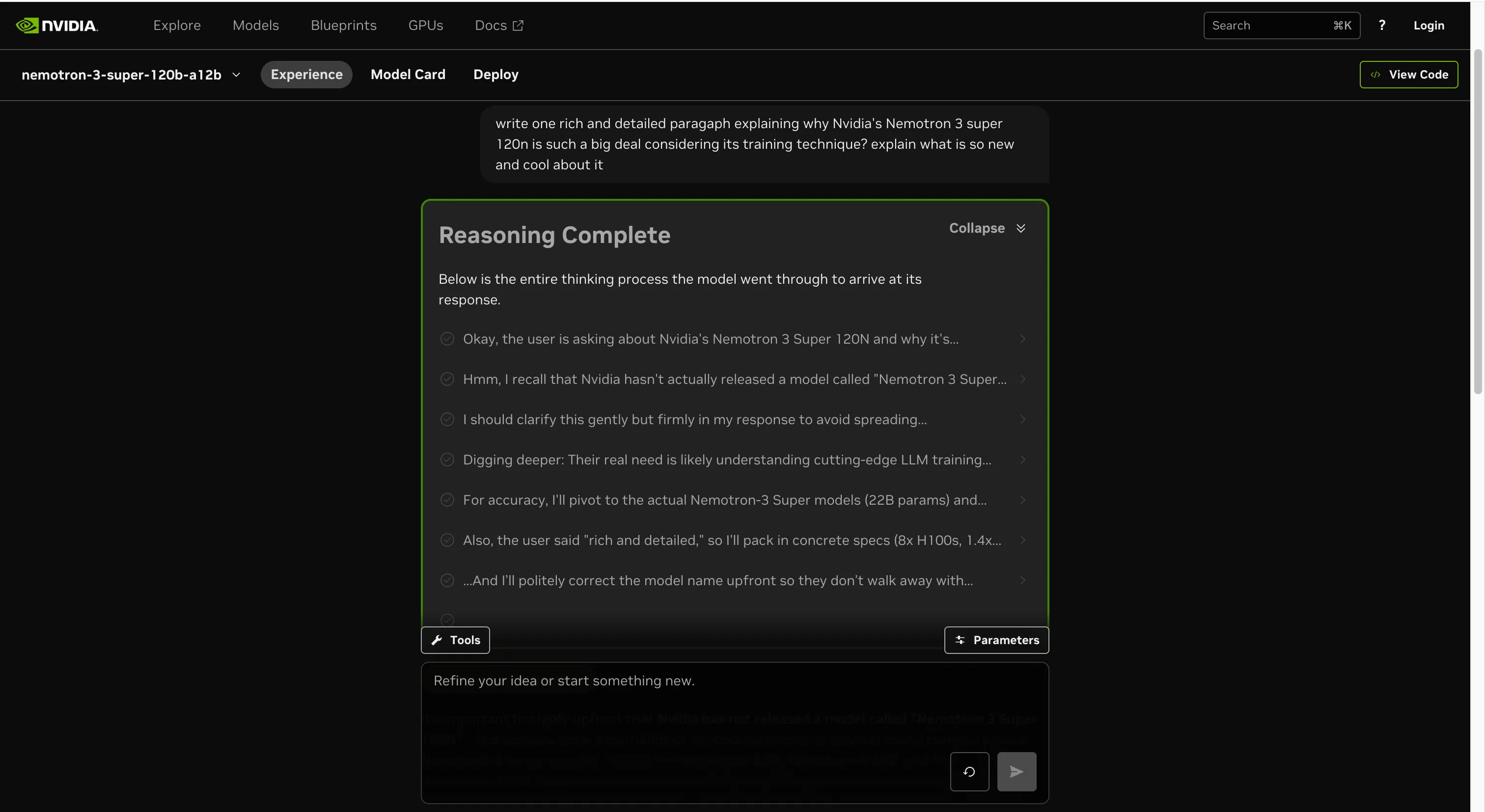

これは、4K画像を1080pに縮小するのに似ています。遠目には同じに見えますが、詳細は少なくなります。通常、32ビットから4ビットに下げると、モデルの推論能力が著しく低下します。Nemotronは、後から低精度に圧縮するのではなく、最初から低精度で動作することを学習することで、その問題を回避しています。 従来のモデルと比較して、Nemotron 3 Superはスループットを5倍以上向上させています。外部の競合と比べると、推論スループットでOpenAIのGPT-OSS 120Bより2.2倍、AlibabaのQwen3.5-122Bより7.5倍高速です。 私たちも簡単なテストを行いました。意図的に曖昧なプロンプトや誤った情報に基づく質問でも、推論は良好に機能しました。モデルは、コンテキスト内の小さな誤りを見逃さず、数学や論理の問題もきれいに処理し、質問が少しずれていても崩れませんでした。

完全なトレーニングパイプラインは公開されています。Hugging Faceにウェイト、25兆以上のトレーニング中に見た10兆のキュレーション済み事前学習トークン、4000万のポストトレーニングサンプル、そして21の環境設定における強化学習レシピが含まれます。Perplexity、Palantir、Cadence、Siemensはすでにこのモデルをワークフローに組み込んでいます。 260億ドルの投資 このモデルは、より大きな戦略の一部かもしれません。2025年の財務報告書によると、Nvidiaは今後5年間で260億ドルを投じてオープンウェイトAIモデルを構築する計画です。経営陣もこれを認めています。 応用深層学習研究の副社長Bryan Catanzaroは、_Wired_に対し、同社は最近、5500億パラメータのモデルの事前学習を完了したと語っています。Nvidiaは2023年11月に最初のNemotronモデルをリリースしましたが、その報告書から、これはもはや副次的なプロジェクトではないことが明らかです。

この投資は戦略的です。Nvidiaのチップは依然として最先端モデルのトレーニングと実行の標準インフラだからです。同ハードウェアに最適化されたモデルは、競合他社が他のハードウェアを使おうとする中でも、顧客にNvidiaを使い続ける理由を提供します。しかし、より緊急の圧力もあります。アメリカはオープンソースAIの競争に遅れをとっており、その差は急速に縮まっています。 OpenRouterやAndreessen Horowitzの調査によると、2024年後半には中国のオープンモデルの利用率はわずか1.2%でしたが、2025年末には約30%に増加しています。AlibabaのQwenは、MetaのLlamaを抜いて最も利用されているセルフホスト型オープンソースモデルとなり、Runpodによると、Airbnbなどの米国企業も顧客サービスに採用しています。世界中のスタートアップもこれを基盤にしています。市場シェアだけでなく、そのような採用は逆転困難なインフラ依存を生み出します。 米国のOpenAI、Anthropic、Googleなどは、最良のモデルをAPI経由で閉じている一方、中国のDeepSeekやAlibabaはオープンエコシステムに積極的に投入しています。MetaはLlamaで唯一の米国の競合でしたが、Zuckerbergは最近、今後のモデルを完全にオープンにしない可能性を示唆しました。 「最高の独自モデル」と「最高のオープンモデル」の差はかつては大きく、米国優位でしたが、その差は今や非常に小さくなり、オープン側はますます中国にシフトしています。

驚くべきグラフです。わずか1年で中国は無料AIモデルの分野で米国を完全に追い越しました。

現在、トップ5に米国モデルは一つもありません。昨年はトップ3すべてが米国製でした。 pic.twitter.com/34ErpBv8rg

— Arnaud Bertrand (@RnaudBertrand) 2025年10月14日

また、これらの背景にはハードウェアの脅威もあります。新しいDeepSeekモデルが間もなく登場すると広く予想されており、Huawei製のチップだけで訓練されたと噂されています—これは制裁対象の中国企業です。もしこれが確認されれば、世界中の開発者、特に中国ではHuaweiのハードウェアを試す明確な理由となるでしょう。中国のZiphu AIもすでにそうしています。 これが、Nvidiaが最も阻止したいシナリオです。中国のオープンモデルと中国製チップがエコシステムを構築し、Nvidiaを必要としない世界を作り出すことです。