Anthropicがトランプ政権を提訴:「サプライチェーンリスク」ラベルは違法な報復である

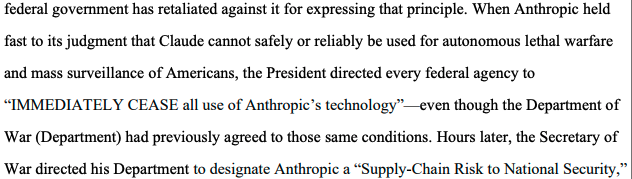

人工知能ソフトウェアClaudeの開発企業であるAnthropicは、月曜日にカリフォルニア連邦裁判所において、トランプ政権を相手取った訴訟を提起しました。同社は、政府が「違法な報復行動」を仕掛けたと非難しており、その理由はAnthropicが軍に対して技術の無制限使用を許可しなかったことにあります。具体的には、致命的な自主兵器や大規模な国内監視に利用されることを防ぐためです。これは米国史上、国内企業が軍のサプライチェーンリスクとして認定された初の事例です。

サプライチェーンリスクの異例の認定

この法的闘争の発端は、2026年3月3日に国防長官のPete Hegsethが最終決定したもので、Anthropicを軍のサプライチェーンリスク企業に指定したことです。この認定の法的結果は非常に重大で、軍と取引のある個人や企業は、Anthropicとの取引を一切行えなくなり、連邦調達市場から完全に排除されることを意味します。

この種のサプライチェーンリスクの認定は、従来、外国の敵対勢力と関係があると認定された企業にのみ適用されてきましたが、米国内の企業に対しては初めての事例です。Anthropicは訴訟の中でこれを「前例のない違法な行為」と呼び、「憲法は、政府が保護された言論に対してその巨大な権力を行使して罰することを許さない」と主張しています。

この訴訟の被告は、Pete Hegseth(国防長官)、Scott Bessent(財務長官)、Marco Rubio(国務長官)を含む、合計17の政府機関や官僚を含む、多数の高官と機関です。米国連邦政府の主要部門を網羅しています。

Anthropicの核心的ライン:致命兵器と大規模監視

(出典:CourtListener)

(出典:CourtListener)

訴訟の中で、AnthropicはHegsethが「使用制限の完全放棄」を求めたと述べていますが、これを拒否した理由は、これらの制限条項自体が政府との契約の一部であり、Claudeが特定の用途に使われるのを防ぐためのものであるからです。具体的には、

致命的な自主兵器システム:人間の最終決定を必要としない自動殺傷決定システム

米国市民に対する大規模監視:AI技術を用いた市民の個人データの大規模収集と分析

といった用途です。訴訟の中で、Anthropicは明確に述べています。「Anthropicはこれらの用途に対してClaudeをテストしたことはなく、現在のところ、致命的な自主戦争を支援するためにClaudeを使用した場合に、その信頼性や安全性が確保できるかどうかもわかりません。」

この立場は、Anthropicの長年にわたるAI安全性優先の原則と一致していますが、トランプ政権による軍事AIの拡大政策とは根本的に対立しています。特に、米国政府と五角軍事部は2024年以降、Anthropicの技術を使用しており、Claudeは機密作業環境に最初に展開されたAIです。今回の認定には、トランプ大統領が連邦職員にClaudeの使用停止を直接命じた行政命令も伴っています。

OpenAIとGoogleのエンジニアによる連名支援:AI業界の連帯

法的闘争が始まると、AI業界からの反応は迅速かつ広範囲に及びました。月曜日、OpenAIやGoogleの30名以上のエンジニアや科学者(Googleの最高科学者Jeff Deanも含む)が、法的支援の意見書(amicus brief)を提出し、公開でAnthropicを支持しました。

これらの業界関係者は、書面の中で次のように警告しています。「このような米国の先端AI企業に対する懲罰的措置を許容し続けると、米国の人工知能やその他の分野における工業・科学競争力に悪影響を及ぼすことは間違いありません。」この見解は、より広範な懸念を示しています。すなわち、米国政府がサプライチェーンリスクを理由に国内AI企業を弾圧すれば、米国のグローバルなAI競争における中国への対抗優位性が損なわれる可能性があるというものです。

よくある質問

「サプライチェーンリスク」タグはAnthropicに具体的にどのような影響を与えるのか?

米国の法律によると、サプライチェーンリスク企業に指定されると、軍と取引のある個人や法人は、その企業との取引を一切行えなくなります。これは、Anthropicを連邦政府の調達エコシステムから排除することを意味し、その影響は直接的な軍事契約だけでなく、政府と関係のあるすべてのサプライヤーやパートナーに及びます。

Anthropicはなぜ致命的兵器に関する用途を拒否したのか?

Anthropicの立場は、Claudeはこれまで致命的自主兵器のシナリオに対してテストや安全評価を行ったことがなく、現状ではその信頼性や安全性を保証できないというものです。さらに、Anthropicは一貫してAIの安全性を最優先しており、高リスクの自主決定システムを十分なテストなしに展開することに反対しています。特に人命に関わる軍事用途ではなおさらです。

GoogleやOpenAIのエンジニアの支援は何を意味するのか?

競合他社のエンジニアや科学者30名以上が、商業的な競争を超えて連名で支援を表明したことは、AI業界全体が政府によるサプライチェーンタグによるAI企業への干渉に対して深刻な懸念を抱いている証拠です。彼らの支援は、もし政府がこのような手段で協力しないAI企業を抑圧できるなら、技術の開放を拒む企業も同じ運命に直面する可能性があるという共通の危機感を示しています。