crypto花椒

用戶暫無簡介

crypto花椒

OpenAI又砍了一个產品

這次是"Adult Mode"——還沒上線就被擱置了

但值得說的不是"成人模式"本身,是OpenAI的產品策略出了什麼問題。

Adult Mode這件事:去年10月宣布,12月原定上線。結果OpenAI自己請的8位心理健康顧問全票反對。

原因:年齡驗證系統有12%失敗率——數百萬未成年人可能接觸到成人內容。 技術上也做不到:之前訓練模型專門回避色情內容,現在要它生成的同時過濾非法內容。模型做不到這個切換。

3月26日,無限期搁置T

TechCrunch的標題很精準:"OpenAI abandons yet another side quest." 但這不是重點。

重點是這個模式:宣布→延期→搁置/取消。 過去一年OpenAI砍掉了什麼: Sora視頻——拿了Disney deal,330萬下載,App Store第一。

3月24日關停。總收入210萬美元,GPU電費都不夠。 Stargate擴建——和Oracle談不攏融資,取消。 應用內購物——宣布了,取消了。 硬體設備——承諾今年出,法庭文件顯示推遲到2027。

看到pattern了嗎?

OpenAI的AI做得不差。GPT依然強,o系列有真東西。問題是AI之外的每一步戰略擴張都失敗了。視頻、硬體、購物、成人內容——每個方向都是宣布、衝刺、撤退。 Sam Altman說"AI

查看原文這次是"Adult Mode"——還沒上線就被擱置了

但值得說的不是"成人模式"本身,是OpenAI的產品策略出了什麼問題。

Adult Mode這件事:去年10月宣布,12月原定上線。結果OpenAI自己請的8位心理健康顧問全票反對。

原因:年齡驗證系統有12%失敗率——數百萬未成年人可能接觸到成人內容。 技術上也做不到:之前訓練模型專門回避色情內容,現在要它生成的同時過濾非法內容。模型做不到這個切換。

3月26日,無限期搁置T

TechCrunch的標題很精準:"OpenAI abandons yet another side quest." 但這不是重點。

重點是這個模式:宣布→延期→搁置/取消。 過去一年OpenAI砍掉了什麼: Sora視頻——拿了Disney deal,330萬下載,App Store第一。

3月24日關停。總收入210萬美元,GPU電費都不夠。 Stargate擴建——和Oracle談不攏融資,取消。 應用內購物——宣布了,取消了。 硬體設備——承諾今年出,法庭文件顯示推遲到2027。

看到pattern了嗎?

OpenAI的AI做得不差。GPT依然強,o系列有真東西。問題是AI之外的每一步戰略擴張都失敗了。視頻、硬體、購物、成人內容——每個方向都是宣布、衝刺、撤退。 Sam Altman說"AI

- 打賞

- 1

- 留言

- 轉發

- 分享

歐洲人在陽台上建太陽能電站了,插座式太陽能板:小的€200,帶儲能的不到€1000,回本2-6年

德國2022-2025裝了超過100萬套陽台太陽能。價格腰斬。英國剛合法化——考慮到英國電價全歐第三貴,有動力。

能源獨立這個概念以前是國家層面的事。現在普通家庭€200就能開始。

去中心化不只是crypto的敘事。能源也在走這條路。

查看原文德國2022-2025裝了超過100萬套陽台太陽能。價格腰斬。英國剛合法化——考慮到英國電價全歐第三貴,有動力。

能源獨立這個概念以前是國家層面的事。現在普通家庭€200就能開始。

去中心化不只是crypto的敘事。能源也在走這條路。

- 打賞

- 按讚

- 留言

- 轉發

- 分享

Anthropic確認了:正在測試一個"step change"級別的新模型。

代號Mythos,內部代號Capybara。洩露是意外,但模型是真的。

之前的AI發布怎麼說?"在XX benchmark上提升了X%"、"更快更便宜"、"支持更長上下文"。

Mythos的描述呢?"遠遠領先於任何其他AI模型的網絡安全能力"、"預示著一波能以遠超防禦者方式利用漏洞的模型"。

看出區別了嗎?

之前是"我們更好了"。這次是"我們強到可能構成風險"。

Anthropic一直是AI安全敘事最強的公司。他們的RSP(Responsible Scaling Policy)本質是給自己設限——模型能力超過某個閾值,必須增加對應安全措施才能發布。

Mythos可能是第一個真正觸發高級別安全審查的模型。

Anthropic可能短期會非常謹慎。"有限客戶早期訪問"+"聚焦網絡安全防禦者"。不是面向消費者的全量發布。

長期來看,AI能力曲線可能不是線性的。"Step change"意味著跳躍——上一個模型到這個模型不是10%提升,是質變。

查看原文代號Mythos,內部代號Capybara。洩露是意外,但模型是真的。

之前的AI發布怎麼說?"在XX benchmark上提升了X%"、"更快更便宜"、"支持更長上下文"。

Mythos的描述呢?"遠遠領先於任何其他AI模型的網絡安全能力"、"預示著一波能以遠超防禦者方式利用漏洞的模型"。

看出區別了嗎?

之前是"我們更好了"。這次是"我們強到可能構成風險"。

Anthropic一直是AI安全敘事最強的公司。他們的RSP(Responsible Scaling Policy)本質是給自己設限——模型能力超過某個閾值,必須增加對應安全措施才能發布。

Mythos可能是第一個真正觸發高級別安全審查的模型。

Anthropic可能短期會非常謹慎。"有限客戶早期訪問"+"聚焦網絡安全防禦者"。不是面向消費者的全量發布。

長期來看,AI能力曲線可能不是線性的。"Step change"意味著跳躍——上一個模型到這個模型不是10%提升,是質變。

- 打賞

- 按讚

- 留言

- 轉發

- 分享

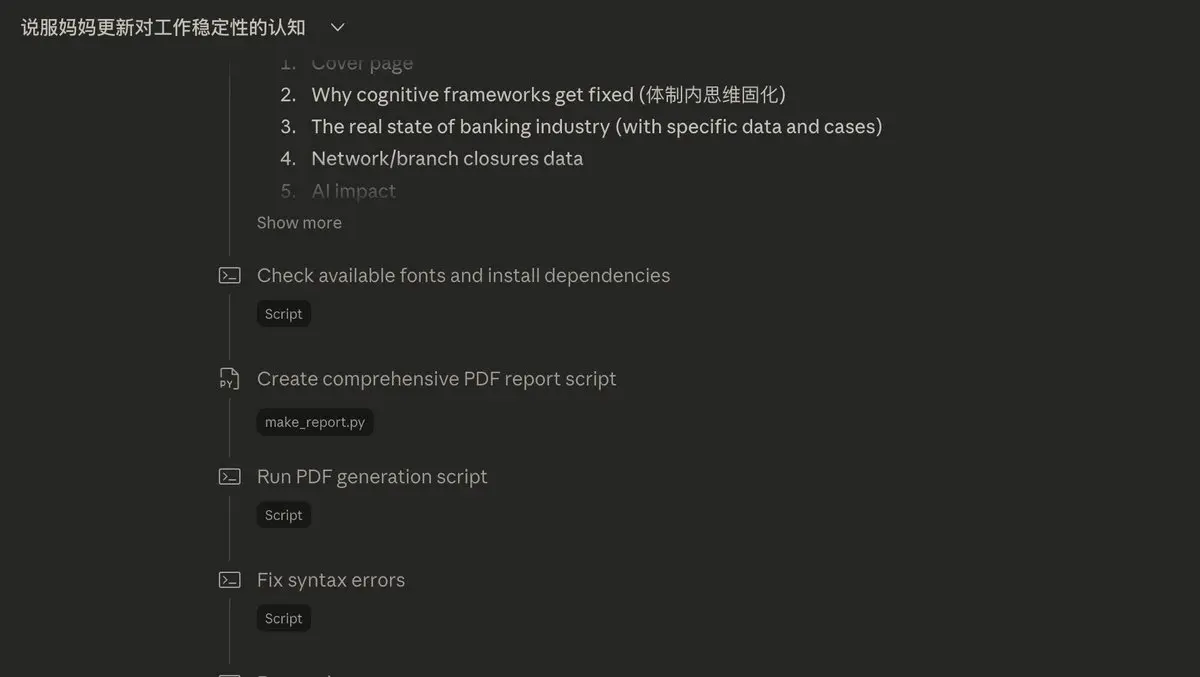

當你無法說服你媽對於「就業穩定的思維僵化」

這時候只能和claude聊聊,讓他出一個pdf了

既然我劝不了我媽,只能AI來劝我媽了

查看原文這時候只能和claude聊聊,讓他出一個pdf了

既然我劝不了我媽,只能AI來劝我媽了

- 打賞

- 按讚

- 留言

- 轉發

- 分享

Google 發了一篇論文叫 TurboQuant,24 小時之內社區就在往 llama.cpp 移植了

TurboQuant 幹了什麼?把大模型的 KV 緩存壓縮到 3-bit,內存佔用砍了 6 倍,推理速度在 H100 上快了 8 倍

關鍵是——不需要重新訓練,不需要微調,不掉精度。 這就是為什麼芯片股暴跌的原因之一。

Samsung、SK Hynix 在首爾跌了 6%+,Micron 在美股跌了 6.9%。

市場怕的是——如果每個模型都能少用 6 倍內存,那 HBM 的需求不就打折了?

但我覺得市場反應過度了。 原因很簡單。 省下來的內存不會閒著。更小的 KV 緩存意味著同一張卡能跑更大的上下文、更多的並發請求。需求不會減少,只會被重新分配。

這在技術史上反覆出現過——CPU 變快了,軟體吃掉了所有性能餘量。帶寬變大了,視頻流吃掉了所有帶寬。內存變省了,模型會變得更大更貪。

llama.cpp Discussion #20969 已經有可運行的 CPU 實現(純 C,無依賴)和 CUDA 核心。

有人在 Apple Silicon 上用 Metal 跑通了。 這意味著本地跑模型的門檻又降了一級。

TurboQuant 短期利空芯片股情緒,中期是整個 AI 行業的效率紅利。 跑本地模型的人賺了——同樣的 Mac 能塞進更大的模型。 芯片公司別慌—

查看原文TurboQuant 幹了什麼?把大模型的 KV 緩存壓縮到 3-bit,內存佔用砍了 6 倍,推理速度在 H100 上快了 8 倍

關鍵是——不需要重新訓練,不需要微調,不掉精度。 這就是為什麼芯片股暴跌的原因之一。

Samsung、SK Hynix 在首爾跌了 6%+,Micron 在美股跌了 6.9%。

市場怕的是——如果每個模型都能少用 6 倍內存,那 HBM 的需求不就打折了?

但我覺得市場反應過度了。 原因很簡單。 省下來的內存不會閒著。更小的 KV 緩存意味著同一張卡能跑更大的上下文、更多的並發請求。需求不會減少,只會被重新分配。

這在技術史上反覆出現過——CPU 變快了,軟體吃掉了所有性能餘量。帶寬變大了,視頻流吃掉了所有帶寬。內存變省了,模型會變得更大更貪。

llama.cpp Discussion #20969 已經有可運行的 CPU 實現(純 C,無依賴)和 CUDA 核心。

有人在 Apple Silicon 上用 Metal 跑通了。 這意味著本地跑模型的門檻又降了一級。

TurboQuant 短期利空芯片股情緒,中期是整個 AI 行業的效率紅利。 跑本地模型的人賺了——同樣的 Mac 能塞進更大的模型。 芯片公司別慌—

- 打賞

- 按讚

- 留言

- 轉發

- 分享

Meta又裁了700人。

這是2026年第二輪了。1月砍了Reality Labs 10%,這次是銷售、招聘和全球運營。

Zuckerberg的原話:「以前需要一個大團隊的項目,現在一個厲害的人就能搞定。」

同時Meta今年capex預算1150-1350億美金,全砸數據中心。

裁人+砸錢建AI基礎設施。

這就是2026年大廠的標準操作。

不是不需要人了,是需要的人變了。

查看原文這是2026年第二輪了。1月砍了Reality Labs 10%,這次是銷售、招聘和全球運營。

Zuckerberg的原話:「以前需要一個大團隊的項目,現在一個厲害的人就能搞定。」

同時Meta今年capex預算1150-1350億美金,全砸數據中心。

裁人+砸錢建AI基礎設施。

這就是2026年大廠的標準操作。

不是不需要人了,是需要的人變了。

- 打賞

- 1

- 留言

- 轉發

- 分享

因為我個人已經系統性地練了10年了,這個在我看來是基本常識,可能很多人都不知道

即客里下面這個帖子爆了,我就轉來給大家看一下

1)力量訓練/增肌的基本原理是「逼近當前肌肉極限——身體輕微受損,自發進行填補——肌肉得到增長——再次循環」。

可以朴素理解為把肌肉逼急眼了,它就增長了。

2)在這個過程中你的身體是先消耗,後補充,最終沉澱增長。

所以你得先耗得起,然後得補得上。

3)這裡的補就是靠吃+睡。

睡能保底,吃能增量。

不吃會不增長,但是不睡會死。

4)而所有的訓練,包括力量訓練,高強度間歇有氧(HIIT),中高強度有氧(跑步、爬樓、跳),只要是會讓你“氣喘吁吁”的運動都在拉練你的心臟。

5)練心臟的原理和練肌肉是一樣的(因為本質上你的心臟也是一大坨肌肉),就是讓它累——吃睡補充——變強。

6)肌肉變強之後的好處當然是很多的,比如耐力更強,力氣更大,跳一次泵血更充足,能走更多的路,不容易感到累等等。

7)所以非常推薦大家在日常進行肌肉訓練(包括外部的和心臟的),相當於每天買點金子,是好事。

8)但是!(重點)如果你的心臟、身體、肌肉最近已經很累了,就說明你的身體沒錢了!耗不起了!

再去搞中高強度的鍛煉就等於借了高利貸!!!

得不償失!!!

9)如果你已經睡眠不足,那麼唯一的也是最好的運動就是不運動。

就是睡覺。

10)在保證基本睡眠之後,對於大多數普通人來說,能做到「中低強度運動+

查看原文即客里下面這個帖子爆了,我就轉來給大家看一下

1)力量訓練/增肌的基本原理是「逼近當前肌肉極限——身體輕微受損,自發進行填補——肌肉得到增長——再次循環」。

可以朴素理解為把肌肉逼急眼了,它就增長了。

2)在這個過程中你的身體是先消耗,後補充,最終沉澱增長。

所以你得先耗得起,然後得補得上。

3)這裡的補就是靠吃+睡。

睡能保底,吃能增量。

不吃會不增長,但是不睡會死。

4)而所有的訓練,包括力量訓練,高強度間歇有氧(HIIT),中高強度有氧(跑步、爬樓、跳),只要是會讓你“氣喘吁吁”的運動都在拉練你的心臟。

5)練心臟的原理和練肌肉是一樣的(因為本質上你的心臟也是一大坨肌肉),就是讓它累——吃睡補充——變強。

6)肌肉變強之後的好處當然是很多的,比如耐力更強,力氣更大,跳一次泵血更充足,能走更多的路,不容易感到累等等。

7)所以非常推薦大家在日常進行肌肉訓練(包括外部的和心臟的),相當於每天買點金子,是好事。

8)但是!(重點)如果你的心臟、身體、肌肉最近已經很累了,就說明你的身體沒錢了!耗不起了!

再去搞中高強度的鍛煉就等於借了高利貸!!!

得不償失!!!

9)如果你已經睡眠不足,那麼唯一的也是最好的運動就是不運動。

就是睡覺。

10)在保證基本睡眠之後,對於大多數普通人來說,能做到「中低強度運動+

- 打賞

- 按讚

- 留言

- 轉發

- 分享

白宮官推的一連串迷惑行為,讓我感覺他這個號是不是被駭客入侵了。

有人試過撥打過這個454-70這個號碼嗎?

查看原文有人試過撥打過這個454-70這個號碼嗎?

- 打賞

- 按讚

- 留言

- 轉發

- 分享

"AXTI is the new king of US stocks"?

I see posts like this ten times a day on Little Red Book. Just change the ticker and keep hyping.

They're constantly telling you to believe in the light, f*** there's so much light.

Most people can't explain in one sentence what this company does.

AXTI makes compound semiconductor substrates. You've never even heard of it, right?

查看原文I see posts like this ten times a day on Little Red Book. Just change the ticker and keep hyping.

They're constantly telling you to believe in the light, f*** there's so much light.

Most people can't explain in one sentence what this company does.

AXTI makes compound semiconductor substrates. You've never even heard of it, right?

- 打賞

- 按讚

- 留言

- 轉發

- 分享

Your little lobster is most useful for buying discounted flights on 258 for nationwide travel, and then routinely checking this 0 yuan redemption.

This push notification is much better than your daily report push.

查看原文This push notification is much better than your daily report push.

- 打賞

- 按讚

- 留言

- 轉發

- 分享

OpenAI 砍掉了 Sora

去年 9 月高調上線,衝到 App Store 第一。六個月後,關停。

官方說法:"聚焦算力到世界模擬研究和機器人"。翻譯成人話:燒錢太多,用戶留不住。

和 Disney 簽的那個大單?三個月,解約。

做 AI 視頻的朋友們注意了:連 OpenAI 都養不起的產品線,你覺得你的視頻 AI 創業能撐多久?

查看原文去年 9 月高調上線,衝到 App Store 第一。六個月後,關停。

官方說法:"聚焦算力到世界模擬研究和機器人"。翻譯成人話:燒錢太多,用戶留不住。

和 Disney 簽的那個大單?三個月,解約。

做 AI 視頻的朋友們注意了:連 OpenAI 都養不起的產品線,你覺得你的視頻 AI 創業能撐多久?

- 打賞

- 按讚

- 留言

- 轉發

- 分享

OnlyFans老闆走了,43歲,癌症。

Leonid Radvinsky,大多數人沒聽過這個名字,但他可能是過去五年最會賺錢的互聯網老闆之一,2018年花了不到5000萬美元買下OnlyFans 75%股份,到2024年,光分紅就拿了7.01億美元一年。

Forbes估算他去世時身家在47億到78億美元之間。他幾乎不接受採訪,沒有公開社交媒體,連員工都很少見到他。一個真正的幕後玩家。

但我今天想聊的不是他的人生故事,我想聊OnlyFans的商業模式。

這個平台本質上做了一件事:站在創作者和粉絲中間,抽20%,創作者負責內容生產、粉絲維護、流量獲取,平台提供支付通道和基礎設施。

然後拿走每一筆交易的五分之一。2023年平台總交易額超過65億美元,公司利潤超過10億。

Radvinsky一個人拿走4.72億美元的分紅。

這個結構乾淨到讓人嫉妒。沒有庫存,沒有內容審核的大量成本(創作者自負),沒有版權糾紛。

甚至不需要推薦算法。說白了,這就是一台收租機器。

你可以覺得這個行業爭議很大,但從商業結構看,Radvinsky做了三件事做對了:

第一,找到了支付基礎設施極差的領域(成人內容),解決了最核心的痛點。

第二,讓創作者承擔幾乎所有運營成本,平台只做管道。第三,從不出面,從不品牌化自己,讓平台等於品類。

43歲走了,留下來一台年賺10億的

查看原文Leonid Radvinsky,大多數人沒聽過這個名字,但他可能是過去五年最會賺錢的互聯網老闆之一,2018年花了不到5000萬美元買下OnlyFans 75%股份,到2024年,光分紅就拿了7.01億美元一年。

Forbes估算他去世時身家在47億到78億美元之間。他幾乎不接受採訪,沒有公開社交媒體,連員工都很少見到他。一個真正的幕後玩家。

但我今天想聊的不是他的人生故事,我想聊OnlyFans的商業模式。

這個平台本質上做了一件事:站在創作者和粉絲中間,抽20%,創作者負責內容生產、粉絲維護、流量獲取,平台提供支付通道和基礎設施。

然後拿走每一筆交易的五分之一。2023年平台總交易額超過65億美元,公司利潤超過10億。

Radvinsky一個人拿走4.72億美元的分紅。

這個結構乾淨到讓人嫉妒。沒有庫存,沒有內容審核的大量成本(創作者自負),沒有版權糾紛。

甚至不需要推薦算法。說白了,這就是一台收租機器。

你可以覺得這個行業爭議很大,但從商業結構看,Radvinsky做了三件事做對了:

第一,找到了支付基礎設施極差的領域(成人內容),解決了最核心的痛點。

第二,讓創作者承擔幾乎所有運營成本,平台只做管道。第三,從不出面,從不品牌化自己,讓平台等於品類。

43歲走了,留下來一台年賺10億的

- 打賞

- 2

- 留言

- 轉發

- 分享

你們搞法律AI大模型的就是法奸

你們搞導演AI大模型的就是導奸

你們搞投研AI大模型的就是投奸

你們搞地產AI大模型的就是地奸

你們搞加密AI大模型的就是加奸

你們搞美股AI大模型的就是美奸

你們搞體檢AI大模型的就是體奸

你們搞詐騙AI大模型的就是炸奸

查看原文你們搞導演AI大模型的就是導奸

你們搞投研AI大模型的就是投奸

你們搞地產AI大模型的就是地奸

你們搞加密AI大模型的就是加奸

你們搞美股AI大模型的就是美奸

你們搞體檢AI大模型的就是體奸

你們搞詐騙AI大模型的就是炸奸

- 打賞

- 按讚

- 留言

- 轉發

- 分享

去年9月,OpenAI发了一篇论文

论文作者是OpenAI的Adam Tauman Kalai、Edwin Zhang、Ofir Nachum,加上Georgia Tech的Santosh Vempala

他们建立了一个数学框架,核心发现是这个不等式:

生成错误率 ≥ 2 × 判断错误率

假设AI在判断"1+1等于几"这件事上有1%的概率判断错误。那它在生成回答时,出错的概率至少是2%

为什么会放大?因为一个错误的判断会衍生出多个错误的生成。比如AI判断1+1=3,那它同时犯了两个错:说1+1=3是对的,说1+1=2是错的。一个判断错误,至少两个生成错误

如果你回答"我不知道",得0分。如果你瞎猜,哪怕只有10%的概率蒙对,期望得分是0.1分。理性选择?猜。 所以AI不是"学会了说谎"。AI是被训练体系逼着猜的

我做AI自动化做了大半年了。我的整个内容系统——从数据抓取到写作到配图——全是AI在跑

这篇论文改变我什么认知了吗? 说实话,核心认知没变

我一直知道AI会犯错,我的系统设计里每个环节都有人工校验。 但有一件事变清晰了:幻觉不是bug,是feature

所以正确的做法不是等AI变得完美,而是在工作流里假设AI一定会犯错,然后设计兜底机制。

我的做法:

1. 所有AI生成的数据,必须有原始链接可以交叉验证

2. 写作内容里的具体数字,发布前必须人工确认

3. 不

论文作者是OpenAI的Adam Tauman Kalai、Edwin Zhang、Ofir Nachum,加上Georgia Tech的Santosh Vempala

他们建立了一个数学框架,核心发现是这个不等式:

生成错误率 ≥ 2 × 判断错误率

假设AI在判断"1+1等于几"这件事上有1%的概率判断错误。那它在生成回答时,出错的概率至少是2%

为什么会放大?因为一个错误的判断会衍生出多个错误的生成。比如AI判断1+1=3,那它同时犯了两个错:说1+1=3是对的,说1+1=2是错的。一个判断错误,至少两个生成错误

如果你回答"我不知道",得0分。如果你瞎猜,哪怕只有10%的概率蒙对,期望得分是0.1分。理性选择?猜。 所以AI不是"学会了说谎"。AI是被训练体系逼着猜的

我做AI自动化做了大半年了。我的整个内容系统——从数据抓取到写作到配图——全是AI在跑

这篇论文改变我什么认知了吗? 说实话,核心认知没变

我一直知道AI会犯错,我的系统设计里每个环节都有人工校验。 但有一件事变清晰了:幻觉不是bug,是feature

所以正确的做法不是等AI变得完美,而是在工作流里假设AI一定会犯错,然后设计兜底机制。

我的做法:

1. 所有AI生成的数据,必须有原始链接可以交叉验证

2. 写作内容里的具体数字,发布前必须人工确认

3. 不

- 打賞

- 1

- 留言

- 轉發

- 分享

<>一條命令,連接任意 AI (幫忙github點個🌟)

<> 一條命令讓微信連接任意 AI

🤖 多 AI 後端Claude Code CLI · Gemini CLI · Codex CLI · OpenAI API · Anthropic API

🖼️ 圖片理解發送圖片,AI 直接分析內容(視覺模型)

🎙️ 語音識別內置 ASR + 本地 Whisper 雙重兜底

🎬 視頻分析ffmpeg 抽幀 + Whisper 音頻轉錄,全面理解視頻內容

📄 文件解析PDF · Word · Excel · PPT · EPUB · 代碼文件全支持

⚡ 流式輸出AI 回覆實時打字機效果推送到

🔒 零硬編碼所有密鑰通過 Setup Wizard 交互配置,本地存儲

查看原文<> 一條命令讓微信連接任意 AI

🤖 多 AI 後端Claude Code CLI · Gemini CLI · Codex CLI · OpenAI API · Anthropic API

🖼️ 圖片理解發送圖片,AI 直接分析內容(視覺模型)

🎙️ 語音識別內置 ASR + 本地 Whisper 雙重兜底

🎬 視頻分析ffmpeg 抽幀 + Whisper 音頻轉錄,全面理解視頻內容

📄 文件解析PDF · Word · Excel · PPT · EPUB · 代碼文件全支持

⚡ 流式輸出AI 回覆實時打字機效果推送到

🔒 零硬編碼所有密鑰通過 Setup Wizard 交互配置,本地存儲

- 打賞

- 1

- 留言

- 轉發

- 分享

熱門話題

查看更多101.87萬 熱度

140.34萬 熱度

10101.42萬 熱度

84.75萬 熱度

708.03萬 熱度

熱門 Gate Fun

查看更多- 市值:$2231.03持有人數:10.00%

- 市值:$2280.8持有人數:20.15%

- 市值:$2227.58持有人數:10.00%

- 市值:$2231.03持有人數:00.00%

- 市值:$2227.58持有人數:10.00%

置頂

🍀 Spring Date with Fortune, Prizes with Raffle! Growth Value Phase 1️⃣ 7️⃣ Spring Raffle Carnival Begins!

Seize Spring's Good Luck! 👉 https://www.gate.com/activities/pointprize?now_period=17

🌟 How to Participate?

1️⃣ Enter [Square] personal homepage, click the points icon next to your avatar to enter [Community Center]

2️⃣ Complete Square or Hot Chat tasks such as posting, commenting, liking, speaking to earn growth value

🎁 Every 300 points can raffle once, 10g gold bars, Gate Red Bull gift box, VIP experience card and more prizes waiting for you to win!

Details 👉 https://www.gate.com/ann📢 Gate 廣場創作者衝榜火熱開啟!

發文贏獎勵,瓜分 1,500 USDT 總獎池 🔥

活動採用 曝光、互動、交易三重積分制——獲得更多曝光、贏得用戶互動、帶動真實交易,每一項都能為你累積積分,讓優質內容被看見、被獎勵。

✅ 總榜大獎:Top 10 創作者分享 1,050 USDT

✅ 新人 & 回歸激勵:5 位潛力作者各得 30 USDT

✅ 深度內容獎:6 篇優質長文各獲 50 USDT

📅 活動時間:3 月 19 日 - 4 月 4 日

📍 報名鏈接:https://www.gate.com/questionnaire/7494

📄 活動詳情:https://www.gate.com/zh/announcements/article/50265

原創內容、深度思考、真實互動——讓創作更有價值。

#Gate广场 #GateSquare #创作者冲榜 #内容挖矿福利加码,Gate 廣場明星帶單交易員三期招募開啟!

入駐發帖 · 瓜分 $30,000 月度獎池 & 千萬級流量扶持!

如何參與:

1️⃣ 報名成為跟單交易員:https://www.gate.com/copytrading/lead-trader-registration/futures

2️⃣ 報名活動:https://www.gate.com/questionnaire/7355

3️⃣ 入駐 Gate 廣場,持續發布交易相關原創內容

豐厚獎勵等你拿:

首發優質內容即得 $30 跟單體驗金

每雙周瓜分 $10,000U 內容獎池

Top 10 交易員額外瓜分 $20,000U 登榜獎池

精選帖推流、首頁推薦、周度明星交易員曝光

詳情:https://www.gate.com/announcements/article/50291Gate 廣場內容挖礦獎勵繼續升級!無論您是創作者還是用戶,挖礦新人還是頭部作者都能贏取好禮獲得大獎。現在就進入廣場探索吧!

創作者享受最高60%創作返佣

創作者獎勵加碼1500USDT:更多新人作者能瓜分獎池!

觀眾點擊交易組件交易贏大禮!最高50GT等新春壕禮等你拿!

詳情:https://www.gate.com/announcements/article/49802