*Données dernièrement actualisées : 2026-04-24 22:37 (UTC+8)

Au 2026-04-24 22:37, Arm Holdings (ARM) est coté à €200,81, avec une capitalisation boursière totale de €178,54B, un ratio cours/bénéfices (P/E) de 141,57 et un rendement du dividende de 0,00 %. Aujourd'hui, le cours de l'action a fluctué entre €180,00 et €203,29. Le prix actuel est de 11,53 % au-dessus du plus bas de la journée et de 1,22 % en dessous du plus haut de la journée, avec un volume de trading de 13,82M. Au cours des 52 dernières semaines, ARM a évolué entre €85,54 et €203,28, et le prix actuel est à -1,22 % de son plus haut sur 52 semaines.

Statistiques clés de ARM

À propos de ARM

En savoir plus sur Arm Holdings (ARM)

Articles de Gate Learn

Analyse de l’action ARM : Opportunités d’investissement et risques à l’aune de la montée en puissance de l’intelligence artificielle

Le cours de l’action ARM poursuit sa hausse à la suite du récent essor de l’intelligence artificielle, alors que des doutes persistent concernant une valorisation jugée surévaluée. Cet article propose une analyse des perspectives d’investissement d’ARM pour éclairer vos choix d’investissement.

2025-09-19

Comprendre l’action ARM : Ce concepteur de puces pourrait-il s’imposer comme le prochain géant dans l’ère de l’intelligence artificielle ?

Cet article s’ouvre sur le titre ARM et analyse l’impact des stratégies d’intelligence artificielle (IA) et de semi-conducteurs d’ARM sur l’évolution de son cours de bourse. Il intègre la politique d’allocation de capital de SoftBank et les anticipations du marché afin de fournir aux nouveaux investisseurs une grille d’analyse transparente pour leurs décisions d’investissement.

2025-10-15

Analyse simplifiée du titre RM : état des lieux du prix actuel et perspectives à venir

Cet article présente des données à jour sur le prix de l’action ARM, analyse les principaux moteurs de sa performance et offre une vision prospective. Grâce à une rédaction claire et précise, il aide les investisseurs débutants à saisir rapidement les fondamentaux de l’investissement dans ARM.

2025-10-14

FAQ de Arm Holdings (ARM)

Quel est le cours de l'action Arm Holdings (ARM) aujourd'hui ?

Quels sont les prix le plus haut et le plus bas sur 52 semaines pour Arm Holdings (ARM) ?

Quel est le ratio cours/bénéfice (P/E) de Arm Holdings (ARM) ? Que signifie-t-il ?

Quelle est la capitalisation boursière de Arm Holdings (ARM) ?

Quel est le bénéfice par action (EPS) trimestriel le plus récent pour Arm Holdings (ARM) ?

Faut-il acheter ou vendre Arm Holdings (ARM) maintenant ?

Quels sont les facteurs pouvant influencer le cours de l’action Arm Holdings (ARM) ?

Comment acheter l'action Arm Holdings (ARM) ?

Avertissement sur les risques

Avertissement

Autres Marchés de Trading

Arm Holdings (ARM) Dernières Actualités

La carte de développement N1 pour PC à base de puce ARM de NVIDIA apparaît, entrée sur le marché imminente

Message de Gate News, 15 avril — La carte de développement N1 d'NVIDIA, un système sur puce (SoC) basé sur Arm pour les PC sous Windows, co-développée avec MediaTek depuis la fin 2024, a fait son apparition sur une plateforme chinoise de revente d'occasion. La carte est équipée de modules de mémoire SK Hynix LPDDR5X et est proposée au prix de 9,999 yuans (environ $1,370). On pense que les puces N1/N1X sont des dérivés du GB10 utilisé dans le poste de travail IA DGX Spark d'NVIDIA, avec des fréquences d'horloge, une bande passante mémoire et le nombre de cœurs ajustés pour des environnements d'ordinateur portable. N1X intègre 10 cœurs de processeur Arm Cortex-X925 hautes performances, 10 cœurs Cortex-A725 économes en énergie et des cœurs GPU Blackwell, dans le but d'améliorer les capacités de jeu et de création de contenu sur des ordinateurs portables Windows à base d'Arm. Le PDG d'NVIDIA, Jensen Huang, a mentionné pour la première fois la puce N1 en septembre dernier, lors d'une annonce conjointe avec Intel, indiquant qu'elle serait utilisée dans DGX Spark et des produits similaires. La puce devrait être officiellement dévoilée pendant la GTC 2026, qui se tiendra en parallèle avec Computex Taipei du 1er au 4 juin. Lenovo et Dell seraient en train de préparer des lancements de produits connexes.

2026-04-10 06:31SK Telecom avec Arm et Rebellions développent une solution d’inférence pour centres de données d’IA

Nouvelles de Gate News : le 10 avril, SK Telecom a annoncé avoir signé un protocole d’accord (MOU) tripartite avec la société britannique de conception de puces Arm et la start-up sud-coréenne de puces IA Rebellions, afin de développer ensemble des solutions de serveurs d’inférence pour des centres de données d’IA. Selon l’accord, les trois parties combineront le nouvel AGI CPU d’Arm et la puce d’accélération IA RebelCard, que Rebellions devrait lancer au troisième trimestre de cette année, pour développer conjointement des serveurs d’inférence IA, et effectueront des tests et une validation dans les centres de données d’IA de SK Telecom. Parmi elles, l’AGI CPU d’Arm est optimisé pour les environnements d’inférence à haute densité et les déploiements IA à grande échelle, tandis que RebelCard est conçu spécifiquement pour l’inférence IA à grande échelle.

2026-03-25 08:05L'intermédiaire le plus sûr de l'industrie des puces a emprunté le chemin le plus dangereux

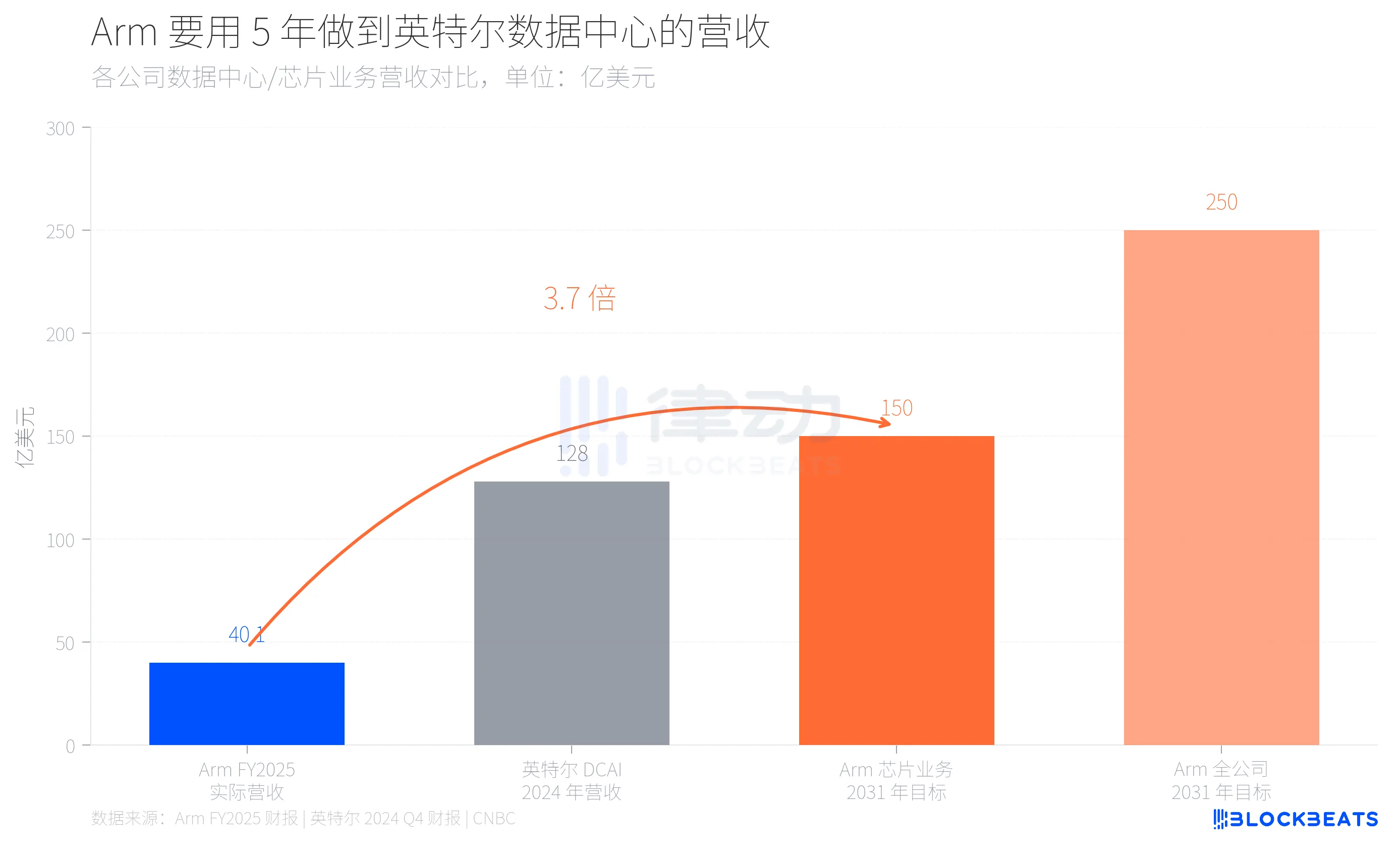

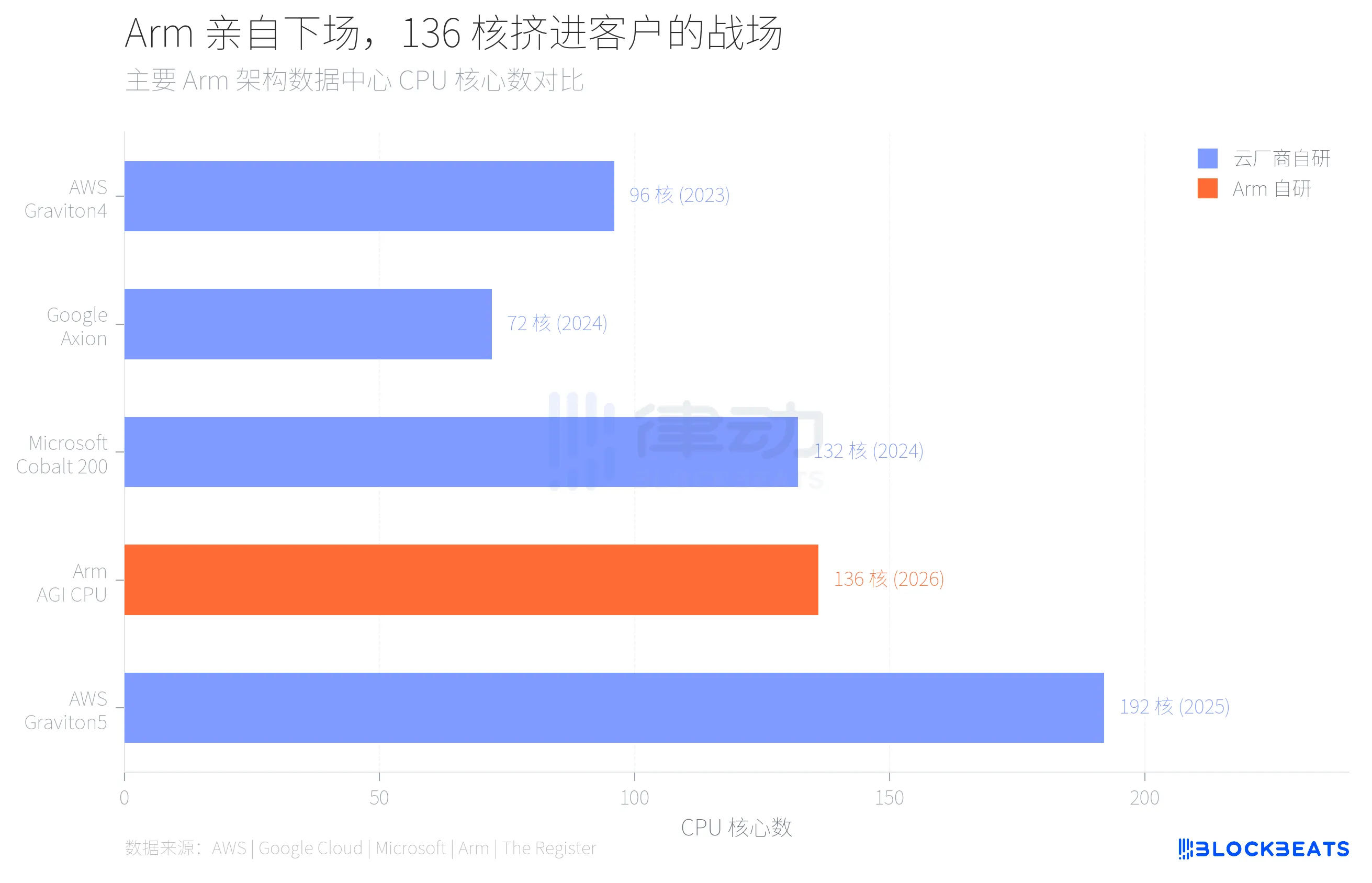

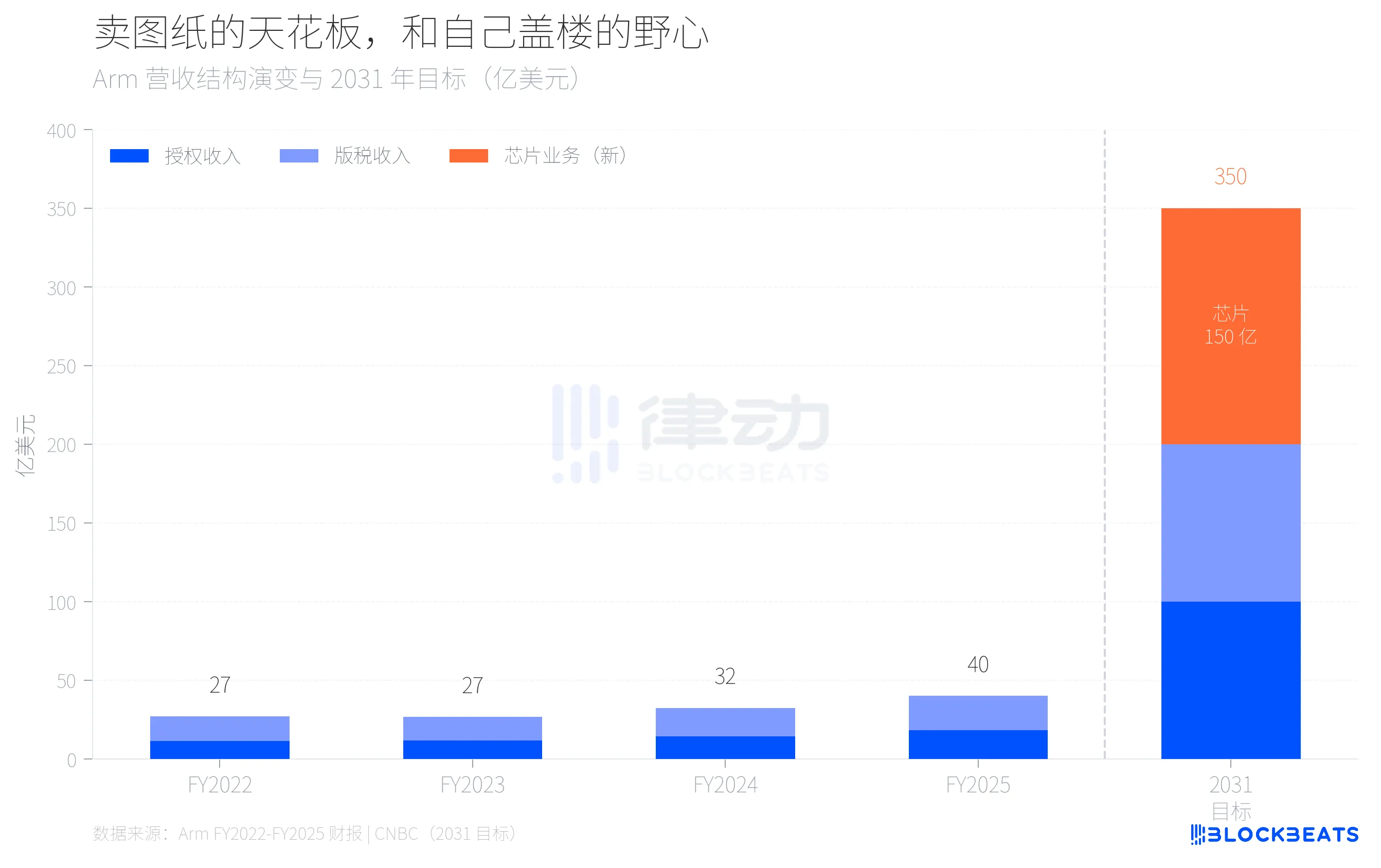

40 milliards de dollars et 150 milliards de dollars, ce n'est pas une courbe de croissance qui les sépare, mais une auto-révolution du modèle commercial. Le 24 mars, Arm a présenté à San Francisco son premier CPU de centre de données conçu en interne en 35 ans d'histoire. Cette puce, nommée AGI CPU, équipée de 136 cœurs Neoverse V3, fabriquée en TSMC en process 3 nm, avec une TDP de 300W, a pour premier client Meta, qui prévoit un déploiement massif dans l'année. La société a également annoncé des collaborations avec OpenAI, Cerebras, Cloudflare, SAP et SK Telecom. Rene Haas, PDG d'Arm, a donné lors de la conférence une série d'objectifs financiers : d'ici 2031, le chiffre d'affaires de la division des puces doit atteindre 15 milliards de dollars par an, avec un chiffre d'affaires total de l'entreprise de 25 milliards de dollars, et un bénéfice par action de 9 dollars. Que signifient ces chiffres ? Arm, pour l'exercice fiscal 2025 (jusqu'en mars 2025), prévoit un chiffre d'affaires total de 4,007 milliards de dollars, selon ses rapports annuels, dont 1,839 milliard de dollars en revenus de licences et 2,168 milliards en royalties, avec une marge brute de 97 %. En d'autres termes, une entreprise réalisant 40 milliards de dollars de revenus annuels doit, en cinq ans, atteindre une échelle proche de celle du département data center d'Intel, uniquement grâce à une nouvelle activité. Selon le rapport financier d'Intel pour le Q4 2024, le département Data Center et AI (DCAI) a généré 12,8 milliards de dollars de revenus pour l'année.  De 40 à 150 milliards, un saut de 3,7 fois, derrière ce changement se cache la tentative d'Arm de passer d'une simple société d'autorisation IP à un hybride vendant à la fois des designs et des produits finis. Cela n'a pas d'équivalent dans l'industrie des puces. Pourquoi Arm prend-il ce risque ? La réponse se trouve dans sa liste de clients. Au cours des trois dernières années, les principaux clients d'Arm dans le domaine des data centers ont tous fait la même chose. Selon des données publiques d'AWS, Amazon a migré plus de 50 % de sa puissance EC2 vers ses propres puces Graviton, dont la dernière, Graviton5, compte 192 cœurs. Google Cloud a révélé que ses puces Axion ont déjà supporté la migration de plus de 30 000 applications internes, avec une amélioration de l'efficacité énergétique de 80 %. Microsoft, avec Cobalt 200, basé également sur l'architecture Neoverse d'Arm, fabriqué en TSMC en process 3 nm, dispose de 132 cœurs.  Ces fournisseurs de cloud utilisent tous l'architecture d'Arm sous licence, mais conçoivent, fabriquent et déploient eux-mêmes leurs puces. Arm perçoit des frais de licence et des royalties, mais pas de profit sur les puces elles-mêmes. À mesure que ces puces auto-conçues absorbent une part croissante de la puissance de calcul, le plafond de revenus d'Arm dans les data centers devient de plus en plus évident. En analysant la structure des revenus d'Arm sur les quatre dernières années, le profil de ce plafond devient plus clair. Selon ses rapports financiers, de FY2022 à FY2025, le chiffre d'affaires total de l'entreprise passera de 2,7 milliards à 4 milliards de dollars, avec une croissance annuelle d'environ 14 %. Les revenus de royalties passeront de 1,562 milliard à 2,168 milliards, et ceux des licences de 1,141 milliard à 1,839 milliard. La croissance des royalties, qui avait ralenti ces dernières années, atteindra environ 20 %, principalement grâce à la mise à niveau vers l'architecture Armv9 sur mobile, et non dans les data centers.  En extrapolant cette croissance à environ 20 % par an pour les licences et royalties, d'ici 2031, le chiffre d'affaires ne pourra atteindre qu'environ 10 milliards de dollars. Les 150 milliards restants devront provenir d'une activité encore inexistante aujourd'hui. C'est cette logique arithmétique qui pousse Arm à fabriquer ses propres puces. Choisir de fabriquer ses propres puces revient à entrer en concurrence avec ses clients. Une entreprise qui vend des plans d'architecture commence à construire ses propres bâtiments, alors que ses acheteurs ont déjà construit depuis plusieurs années. C'est le véritable contexte derrière le CPU AGI à 136 cœurs. Selon The Register, cette puce a une fréquence de base de 3,2 GHz, pouvant atteindre 3,7 GHz, avec 12 canaux de mémoire DDR5, chaque cœur disposant de 6 Go/s de bande passante, 96 voies PCIe 6.0, et supportant CXL 3.0. Arm la positionne comme « la base de puissance pour l'ère du cloud AI agentic », ciblant les tâches de planification CPU et la gestion du flux de données dans l'inférence AI, sans chercher à concurrencer directement les GPU. Le rythme de changement de parts de marché en dit long. Selon Omdia, d'ici 2025, environ 21 % des serveurs dans le monde utiliseront l'architecture Arm, avec une croissance de 70 %. Mais dans les data centers à très grande échelle, cette part approche déjà 50 %. La domination de 40 ans de l'x86 n'est pas en train de s'effondrer, mais d'être remplacée, puce par puce. Le risque d'Arm en développant ses propres puces ne réside pas dans la technique, mais dans la relation. La volonté de Meta d'être le premier client s'explique en partie par le fait que Meta ne dispose pas de projets de puces auto-conçues aussi matures qu'Amazon ou Google. Mais comment Amazon, Google ou Microsoft perçoivent-ils cette démarche ? Lorsqu'un fournisseur commence à vous concurrencer sur votre propre marché, allez-vous continuer à lui confier l'autorisation de votre architecture la plus stratégique ? Le pari d'Arm est que la croissance globale du marché des data centers dépasse la détérioration de ses relations clients. Rene Haas croit fermement que la demande en CPU dans l'ère de l'IA sera suffisamment forte pour que la fabrication interne de puces et l'autorisation d'architectures coexistent. L'objectif de 15 milliards de dollars est une évaluation de cette conviction. 35 ans à vendre des plans, la première fois à construire ses propres bâtiments. Les plans continuent d'être vendus, les bâtiments aussi, mais il faut voir si le terrain peut accueillir tout le monde. Cliquez pour découvrir les opportunités chez BlockBeats. **Rejoignez la communauté officielle de BlockBeats :** Groupe Telegram abonnés : https://t.me/theblockbeats Groupe Telegram général : https://t.me/BlockBeats_App Compte officiel Twitter : https://twitter.com/BlockBeatsAsia

2026-01-29 07:59Gate contrat secteur actions, lancement le 29 janvier, 10 contrats à terme perpétuels sur des actions américaines telles que MSFT, IBM, etc., prenant en charge un effet de levier de 1 à 20 fois

Gate News bot message, selon l'annonce officielle de Gate du 29 janvier 2026 La section des contrats d'actions de Gate sera lancée le 29 janvier 2026 à 19h00 (UTC+8) avec le lancement initial de 10 contrats à terme perpétuels sur les actions américaines MSFT, IBM, INTC, MCD, CSCO, ASML, LLY, MRVL, UNH, ARM, négociés en comptant en USDT. Les paires de trading disponibles incluent MSFT/USDT, IBM/USDT, INTC/USDT, MCD/USDT, CSCO/USDT, ASML/USDT, LLY/USDT, MRVL/USDT, UNH/USDT, ARM/USDT. Les utilisateurs peuvent choisir un levier de 1 à 20 fois pour des transactions longues ou courtes.