Anthropic пред'явила позов уряду Трампа: тег «ризик ланцюга постачання» є незаконним відплатою

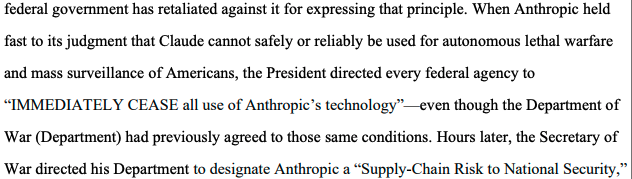

Штучний інтелектовий софт Claude розробляє компанія Anthropic, яка у понеділок подала позов до федерального суду Каліфорнії проти уряду Трампа, звинувативши його у «незаконних репресіях» через відмову дозволити військовим без обмежень використовувати її технології — зокрема для смертельно небезпечних автономних озброєнь та масштабного внутрішнього спостереження. Це вперше в історії США місцева компанія визнана ризиком для військового ланцюга постачань.

Ризики ланцюга постачань: безпрецедентне визнання Пентагону

Початком цієї юридичної боротьби стала остаточна ухвала міністра оборони Піта Хегсета 3 березня 2026 року про внесення Anthropic до списку ризиків для військового ланцюга постачань. Наслідки цього рішення — серйозні й безпосередні: будь-яка особа або компанія, що має справи з військовими, не може одночасно вести будь-які операції з Anthropic, фактично виключаючи її з федерального ринку закупівель.

Звертає на себе увагу, що таке визнання ризиків раніше застосовувалося лише до компаній, пов’язаних із іноземними ворогами, і ніколи — до американських компаній. У позові Anthropic називає це «безпрецедентним і незаконним» і стверджує: «Конституція не дозволяє уряду використовувати свою величезну владу для покарання компанії за захищену свободу слова.»

Обвинувачення включають високопосадовців, зокрема Піта Хегсета (міністра оборони), Скотта Бессента (міністра фінансів), Марко Рубіо (держсекретаря) та ще 17 урядових структур і посадовців, що охоплює кілька ключових департаментів федерального уряду.

Головна червона лінія Anthropic: смертельна зброя та масштабне спостереження

(Джерело: CourtListener)

(Джерело: CourtListener)

Згідно з позовом Anthropic, Хегсетх вимагав від компанії «повністю відмовитися від обмежень використання» — що Anthropic відмовилася зробити, оскільки ці обмеження є частиною її урядового контракту і спрямовані запобігти використанню Claude для двох конкретних цілей:

Смертельно небезпечні автономні системи озброєнь: автоматизовані системи прийняття рішень про вбивство без остаточного підтвердження людиною.

Масове спостереження за громадянами США: використання AI для масового збору та аналізу особистих даних громадян.

У позові Anthropic чітко заявляє: «Anthropic ніколи не тестувала Claude для цих цілей. Наразі Anthropic не впевнена, чи може Claude надійно або безпечно працювати у підтримці смертельної автономної війни.»

Ця позиція відповідає довгостроковій політиці Anthropic щодо безпеки AI, але суперечить політиці розширення військового застосування AI урядом Трампа. Варто зазначити, що з 2024 року уряд і Пентагон вже використовують технології Anthropic, а Claude став першим AI, розгорнутим у секретних робочих середовищах. Це також супроводжувалося наказом Трампа припинити використання Claude федеральними службовцями.

Підтримка з боку OpenAI та Google: колективна відповідь AI-індустрії

Після початку судового процесу реакція AI-індустрії була швидкою і широкою. У понеділок понад 30 інженерів і науковців з OpenAI і Google, включаючи головного науковця Google Джеффа Діна, подали амікусний лист у підтримку Anthropic.

Ці фахівці попереджають: «Якщо дозволити таку каральну політику щодо однієї з провідних американських AI-компаній, це без сумніву негативно вплине на науково-технічну та промислову конкуренцію США у галузі штучного інтелекту та інших сфер.» Це викликає ширше занепокоєння: якщо уряд використовує ланцюг постачань для тиску на вітчизняні AI-компанії, це може послабити ключову перевагу США у глобальній боротьбі з Китаєм у цій галузі.