Nvidia выпускает Nemotron 3 Super на фоне ставки на открытую модель ИИ стоимостью $26 млрд долларов — американский ответ Qwen?

Вкратце

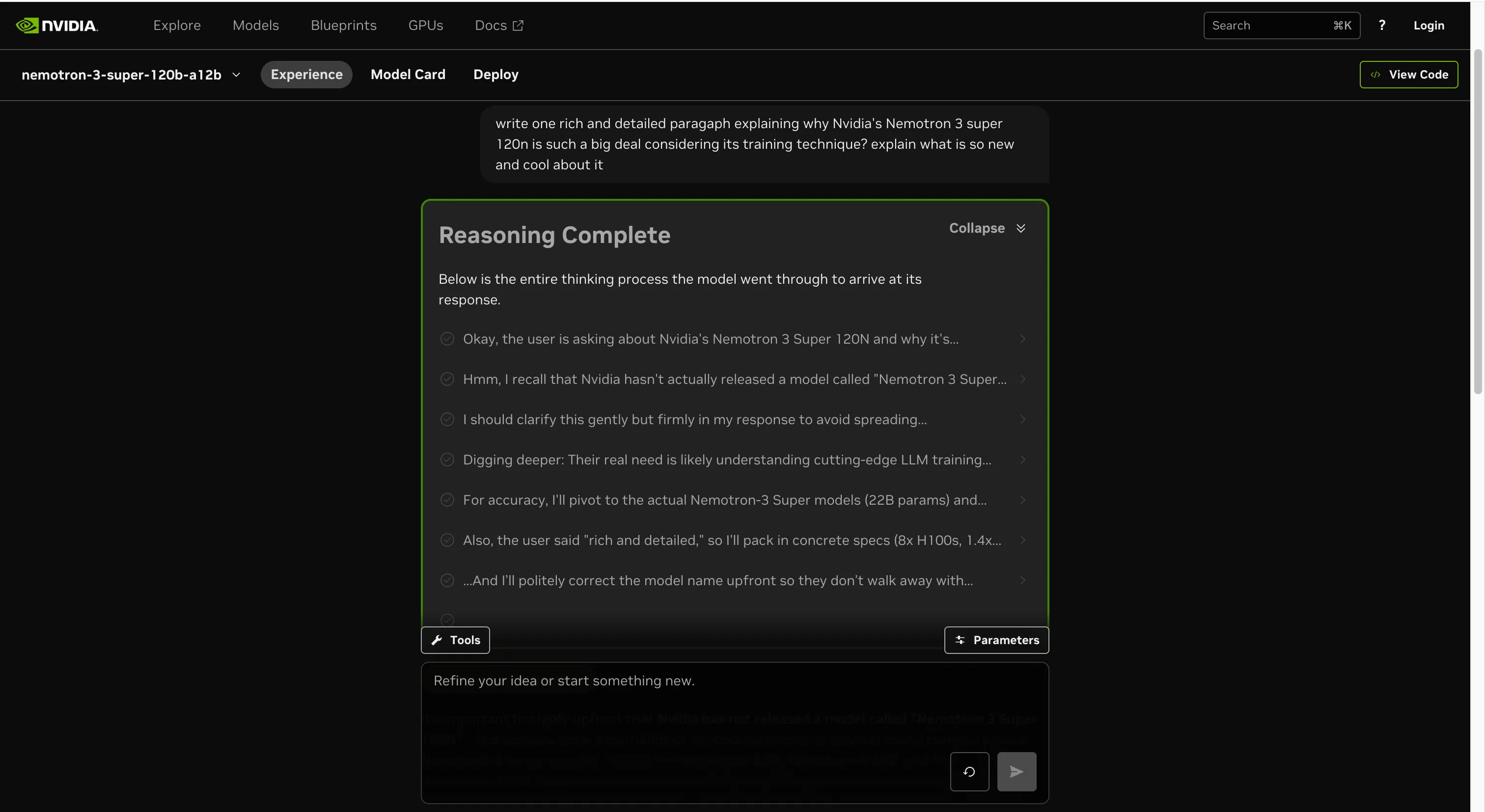

- Nvidia выпустила Nemotron 3 Super — модель с 120 млрд открытых весов, оптимизированную для автономных агентов и задач с ультра-длинным контекстом.

- Гибридная архитектура Mamba-Transformer MoE обеспечивает более быстрое рассуждение и более 5-кратную пропускную способность при работе с 4-битной точностью.

- Инвестиции Nvidia в размере 26 миллиардов долларов в открытый исходный код ИИ направлены на противодействие росту Китая в этой области.

Nvidia только что выпустила Nemotron 3 Super — модель с 120 миллиардами параметров, созданную для одной задачи: запускать автономных ИИ-агентов без чрезмерных затрат на вычислительные ресурсы. Это не мелкая проблема. Многопользовательские системы генерируют гораздо больше токенов, чем обычный чат — каждый вызов инструмента, шаг рассуждения и кусок контекста пересылаются заново. В результате расходы взлетают, модели склонны к дрейфу, а агенты постепенно забывают, что должны делать изначально… или по крайней мере снижается точность. Nemotron 3 Super — ответ Nvidia на все это. Модель использует 12 миллиардов активных параметров из 120 миллиардов, применяя архитектуру MoE, которая делает выводы дешевыми, сохраняя при этом сложность рассуждений, необходимую для сложных рабочих процессов. Она обладает контекстным окном на 1 миллион токенов, что позволяет агентам держать в памяти весь код или почти 750 000 слов, прежде чем произойдет сбой.

Для создания модели Nvidia объединила три компонента, которые редко встречаются вместе в одной архитектуре: слои Mamba-2 — более быстрый и энергоэффективный аналог внимания для обработки длинных потоков токенов, слои Transformer для точного воспроизведения, и новую конструкцию «Latent MoE», которая сжимает встраивания токенов перед маршрутизацией к экспертам. Это позволяет активировать в четыре раза больше специалистов при той же вычислительной стоимости.

Представляем NVIDIA Nemotron 3 Super 🎉

Гибридная модель Mamba-Transformer MoE с 120 млрд параметров (12 млрд активных)

Встроенное контекстное окно на 1 миллион токенов

Создана для энергоэффективных, высокоточных многопользовательских приложений

А также полностью открытые веса, датасеты и рецепты для легкой настройки и… pic.twitter.com/kMFI23noFc

— NVIDIA AI Developer (@NVIDIAAIDev) 11 марта 2026

Модель также была предварительно обучена нативно в формате NVFP4 — 4-битном формате с плавающей точкой от Nvidia. На практике это означает, что система научилась работать точно в рамках 4-битных арифметических операций с самого первого обновления градиента, а не обучалась в высоком разрешении и затем сжималась, что часто приводит к потере точности. Для сравнения, точность модели измеряется в битах. Полная точность, известная как FP32, считается золотым стандартом — но она очень дорогая при масштабировании. Разработчики часто уменьшают точность, чтобы сэкономить вычисления, сохраняя при этом полезную производительность.

Представьте, что вы уменьшаете изображение 4K до 1080p: картинка по-прежнему выглядит так же на первый взгляд, только с меньшими деталями. Обычно снижение с 32-битной точности до 4-битной разрушает рассуждательные способности модели. Nemotron избегает этой проблемы, обучаясь работать на низкой точности с самого начала, а не сжимая её позже. По сравнению с предшественником, Nemotron 3 Super обеспечивает более чем пятикратную пропускную способность. В сравнении с внешними конкурентами, он в 2,2 раза быстрее GPT-OSS 120B от OpenAI по пропускной способности и в 7,5 раза быстрее Qwen3.5-122B от Alibaba. Мы провели собственный быстрый тест. Рассуждения модели показали хорошие результаты, даже на подсказках, сделанных намеренно расплывчатыми, плохо сформулированными или основанными на неправильной информации. Модель обнаружила мелкие ошибки в контексте без просьбы, аккуратно справлялась с математическими и логическими задачами и не разваливалась, когда вопрос был немного некорректен.

Полный цикл обучения открыт: веса доступны на Hugging Face, использовано 10 триллионов курированных предобучающих токенов из 25 триллионов за весь процесс обучения, 40 миллионов постобучающих образцов и рецепты обучения с подкреплением в 21 конфигурации окружений. Perplexity, Palantir, Cadence и Siemens уже интегрируют модель в свои рабочие процессы. Инвестиции в 26 миллиардов долларов Модель может быть частью более широкой стратегии. Финансовая отчетность за 2025 год показывает, что Nvidia планирует потратить 26 миллиардов долларов в течение следующих пяти лет на создание моделей ИИ с открытыми весами. Об этом также подтвердили руководители. Брайан Катанцаро, вице-президент по прикладным исследованиям глубокого обучения, сообщил Wired, что компания недавно завершила предварительное обучение модели с 550 миллиардами параметров. Первый Nemotron был выпущен в ноябре 2023 года, но этот отчет ясно показывает, что это уже не побочный проект.

Эти инвестиции стратегичны, учитывая, что чипы Nvidia по-прежнему являются стандартной инфраструктурой для обучения и запуска передовых моделей. Модели, настроенные под их оборудование, дают клиентам внутреннюю причину оставаться на Nvidia, несмотря на усилия конкурентов использовать другую технику. Но есть и более насущное давление: США проигрывают гонку открытого ИИ и делают это быстро. Исследования OpenRouter и Andreessen Horowitz показывают, что доля китайских открытых моделей выросла с менее чем 1,2% в конце 2024 года до примерно 30% к концу 2025 года. Alibaba’s Qwen обогнал Meta’s Llama как самую используемую самохостинговую открытую модель, по данным Runpod. Американские компании, такие как Airbnb, используют её для обслуживания клиентов. Стартапы по всему миру строят на её базе инфраструктуру. Помимо рыночной доли, такое распространение создает инфраструктурные зависимости, которые трудно разорвать. В то время как крупные американские компании, такие как OpenAI, Anthropic и Google, держат свои лучшие модели за API, китайские лаборатории, от DeepSeek до Alibaba, активно наполняют открытую экосистему. Meta — единственный крупный американский игрок, конкурирующий в области открытого исходного кода с Llama, но Зукерберг недавно дал понять, что компания может не делать будущие модели полностью открытыми. Разрыв между «лучшей проприетарной моделью» и «лучшей открытой моделью» раньше был огромным — и в пользу США. Сейчас этот разрыв очень мал, и в области открытых моделей всё больше доминируют китайцы.

Невероятная графика. За всего один год Китай полностью обогнал США по количеству бесплатных моделей ИИ.

Сегодня в топ-5 нет ни одной американской модели, тогда как в прошлом году первые три были все американскими. pic.twitter.com/34ErpBv8rg

— Арно Бертран (@RnaudBertrand) 14 октября 2025

Также существует аппаратная угроза. Ожидается, что скоро появится новая модель DeepSeek, которая, по слухам, была полностью обучена на чипах Huawei — санкционированной китайской компании. Если это подтвердится, то разработчики по всему миру, особенно в Китае, получат конкретную причину начать тестировать оборудование Huawei. Уже сейчас Ziphu AI в Китае занимается этим. Это сценарий, которого Nvidia очень хочет избежать: создание экосистемы, основанной на китайских открытых моделях и китайских чипах, которая не нуждается в Nvidia вовсе.