Ferramenta de IA do Google Prevê Inundações Repentinas até 24 Horas Antes

Resumo

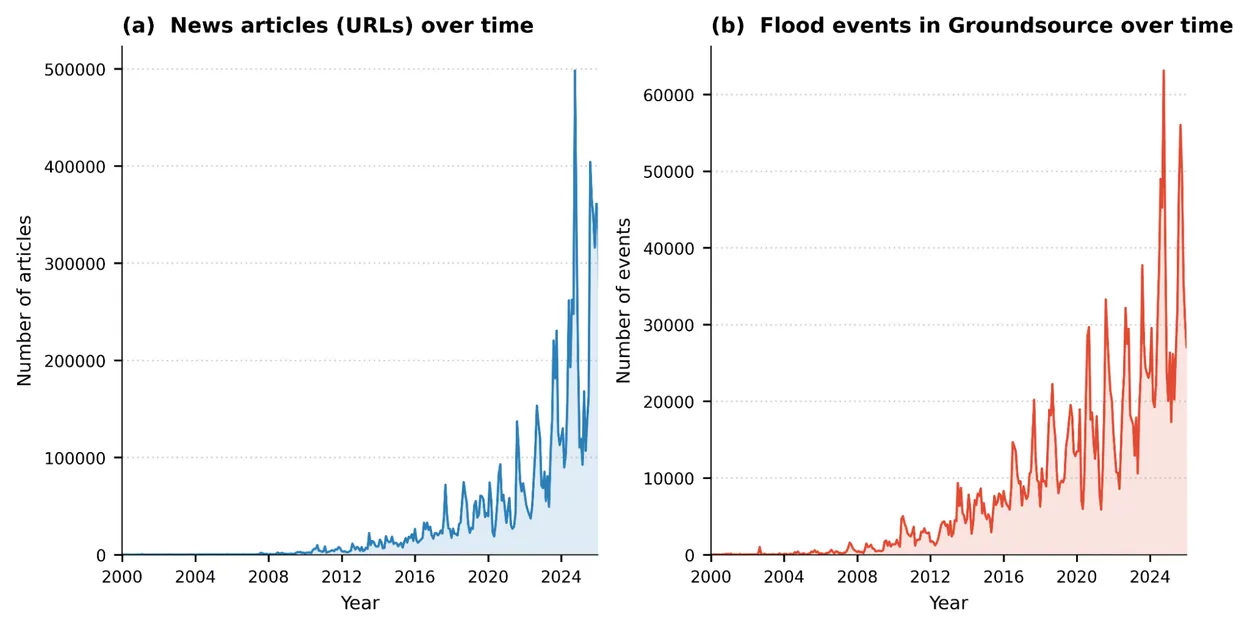

- O Google criou o maior conjunto de dados de inundações repentinas de sempre, usando o Gemini para analisar duas décadas de notícias globais.

- O conjunto de dados agora alimenta um modelo de IA que prevê inundações urbanas até 24 horas antes.

- O sistema preenche uma grande lacuna de dados que há muito bloqueava a previsão de inundações repentinas.

Inundações repentinas matam milhares de pessoas todos os anos. Elas acontecem rapidamente, atingem as cidades com mais força e, durante décadas, quase não havia o que os cientistas pudessem fazer para antecipá-las, porque os dados para treinar modelos de previsão simplesmente não existiam. Na quinta-feira, o Google anunciou que encontrou uma solução para esse problema—lendo as notícias. A empresa revelou o Groundsource, um sistema que usa o IA Gemini para vasculhar milhões de artigos de notícias publicados desde 2000, extrair referências a eventos de inundação e associar cada uma a uma localização e uma data. O resultado é um conjunto de dados com 2,6 milhões de inundações repentinas históricas, abrangendo mais de 150 países, e agora disponível para download e uso por qualquer pessoa.

Esse conjunto de dados foi então usado para treinar um novo modelo de IA capaz de prever se uma inundação repentina é provável de atingir uma área urbana nas próximas 24 horas. As previsões já estão disponíveis no Flood Hub do Google, a mesma plataforma que a empresa já usa para alertar cerca de 2 bilhões de pessoas sobre inundações relacionadas a rios em todo o mundo. O problema que o Groundsource resolve é surpreendentemente simples. Os rios possuem medidores físicos—sensores colocados na água que registram níveis há décadas. É assim que os meteorologistas aprenderam a prever quando um rio vai transbordar. As ruas das cidades não têm nada parecido. Quando uma chuva intensa atinge o pavimento e sobrecarrega os sistemas de drenagem, a inundação acontece de forma rápida e local demais para ser monitorada com instrumentos tradicionais. Sem registros históricos, não é possível treinar um modelo de IA para reconhecer o padrão. A solução do Google foi tratar os artigos de notícias como o sensor que falta.

“Transformando informações públicas em dados acionáveis, não estamos apenas analisando o passado—estamos construindo um futuro mais resiliente para todos, rumo ao nosso objetivo de que ninguém seja surpreendido por um desastre natural,” afirmou o Google.

Fonte: Google

Após filtrar anúncios, menus de navegação e duplicados, e traduzir artigos de outros idiomas para o inglês, a equipe transformou milhões de descrições de texto confusas em dados limpos, geolocalizados e em séries temporais. O modelo treinado com esses dados usa uma rede neural LSTM—um tipo de IA projetada para processar sequências ao longo do tempo—para ingerir previsões horárias do tempo junto com fatores locais como densidade de urbanização, taxas de absorção do solo e topografia. Ele então gera um sinal simples: risco médio ou alto de inundação nas próximas 24 horas, para qualquer área urbana com uma densidade populacional acima de 100 pessoas por quilómetro quadrado. O sistema tem limitações reais. Cobre apenas áreas de cerca de 20 quilómetros quadrados de cada vez, não consegue prever a gravidade de uma inundação, e terá desempenho ruim em regiões onde a cobertura de notícias é escassa. Ainda assim, os resultados iniciais são reveladores. Uma autoridade regional de desastres no Sul de África recebeu um alerta do Flood Hub durante a fase beta, confirmou a inundação no local e enviou um trabalhador humanitário para gerenciar a resposta. Segundo Juliet Rothenberg, diretora de resiliência em crises do Google, “essa cadeia de eventos, do aviso no Flood Hub até a presença no terreno, é exatamente o que o Flood Hub foi criado para fazer.”