Nvidia lance Nemotron 3 Super dans le cadre d'un pari sur les modèles ouverts à $26 Milliards—La réponse américaine à Qwen ?

En résumé

- Nvidia a lancé Nemotron 3 Super, un modèle d’IA open-weight de 120 milliards de paramètres optimisé pour les agents autonomes et les tâches à contexte ultra-long.

- L’architecture hybride Mamba-Transformer MoE offre un raisonnement plus rapide et un débit supérieur à 5 fois tout en fonctionnant en précision 4 bits.

- L’investissement de Nvidia de 26 milliards de dollars dans l’IA open-source vise à contrer la montée en puissance de la Chine dans ce domaine.

Nvidia vient de livrer Nemotron 3 Super, un modèle open-weight de 120 milliards de paramètres conçu pour une seule chose : faire fonctionner des agents IA autonomes sans épuiser votre budget de calcul. Ce n’est pas un petit problème. Les systèmes multi-agents génèrent beaucoup plus de tokens qu’une conversation normale — chaque appel d’outil, étape de raisonnement et fragment de contexte est renvoyé de zéro. En conséquence, les coûts explosent, les modèles ont tendance à dériver, et les agents oublient peu à peu ce qu’ils étaient censés faire au départ… ou du moins leur précision diminue. Nemotron 3 Super est la réponse de Nvidia à tout cela. Le modèle utilise 12 milliards de paramètres actifs sur 120 milliards au total, avec une architecture de type mixture-of-experts (MoE) qui maintient l’inférence peu coûteuse tout en conservant la profondeur de raisonnement nécessaire aux workflows complexes. Il dispose d’une fenêtre de contexte d’un million de tokens, permettant aux agents de contenir une base de code entière, ou près de 750 000 mots en mémoire avant de se réduire.

Pour construire son modèle, Nvidia a combiné trois composants rarement réunis dans une même architecture : des couches Mamba-2 à espace d’états — une alternative plus rapide et plus efficace en mémoire à l’attention pour gérer de longs flux de tokens —, des couches d’attention Transformer pour une recall précise, et une nouvelle conception “Latent MoE” qui compresse les embeddings de tokens avant de les acheminer vers les experts. Cela permet au modèle d’activer quatre fois plus de spécialistes avec le même coût de calcul.

Présentation de NVIDIA Nemotron 3 Super 🎉

Modèle hybride Mamba-Transformer MoE open 120B paramètres (12B actifs)

Contexte natif de 1 million de tokens

Conçu pour des applications multi-agents efficaces en calcul et haute précision

Plus, poids, datasets et recettes entièrement open pour une personnalisation facile et… pic.twitter.com/kMFI23noFc

— NVIDIA AI Developer (@NVIDIAAIDev) 11 mars 2026

Le modèle a également été pré-entraîné nativement en NVFP4, le format flottant 4 bits de Nvidia. En pratique, cela signifie que le système a appris à fonctionner avec précision en arithmétique 4 bits dès la première mise à jour de gradient, plutôt que d’être entraîné en haute précision puis compressé, ce qui peut souvent entraîner une perte de précision. Pour contextualiser, la précision d’un modèle se mesure en bits. La précision totale, appelée FP32, est la norme d’or — mais elle est aussi extrêmement coûteuse à faire tourner à grande échelle. Les développeurs réduisent souvent la précision pour économiser du calcul tout en essayant de préserver une performance utile.

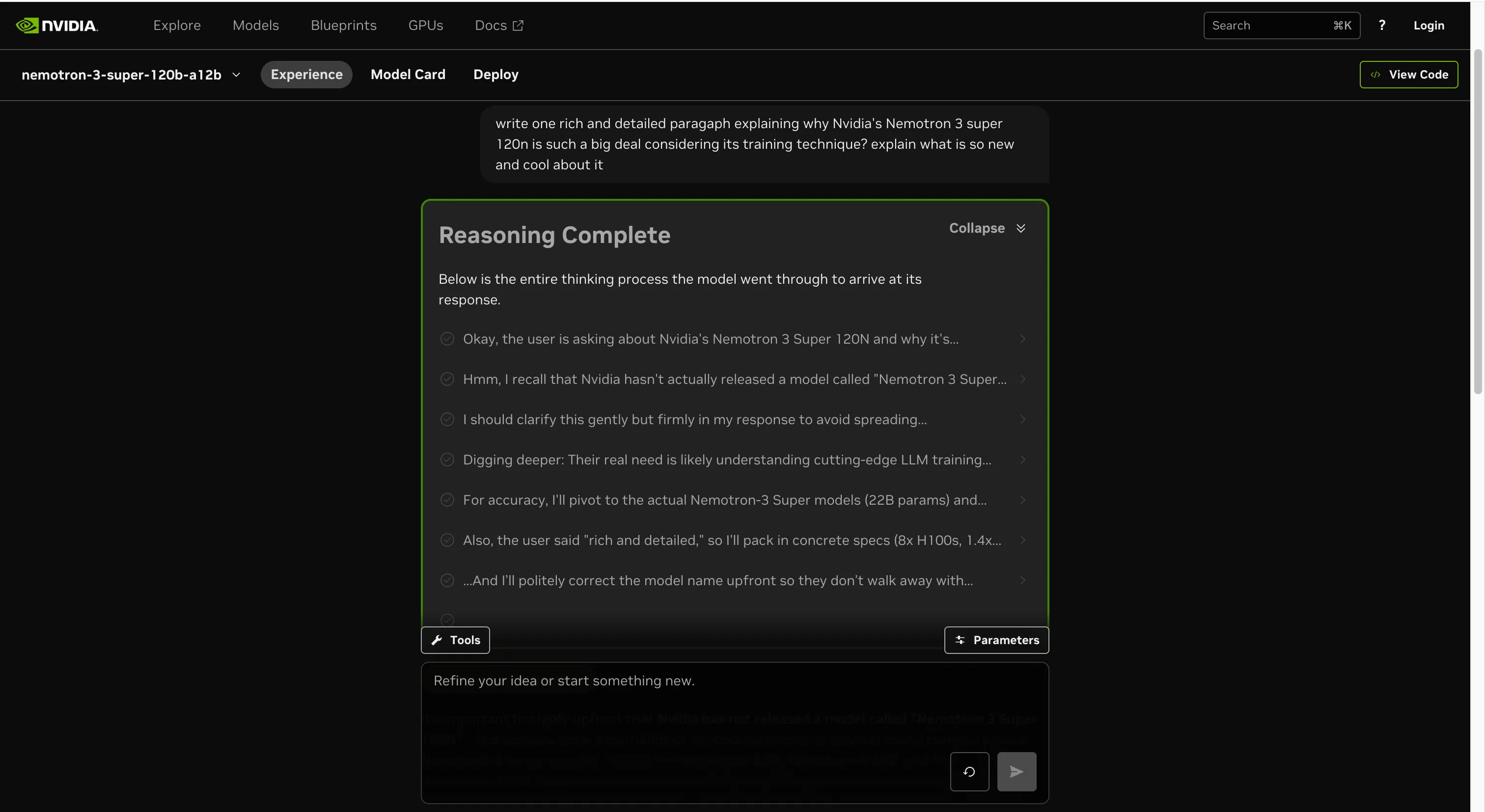

C’est comme réduire une image 4K à 1080p : l’image paraît toujours la même à première vue, mais avec moins de détails. Normalement, passer de 32 bits à 4 bits détruirait la capacité de raisonnement d’un modèle. Nemotron évite ce problème en apprenant à fonctionner en basse précision dès le départ, plutôt que d’y être contraint ultérieurement. Comparé à son prédécesseur, Nemotron 3 Super offre plus de cinq fois le débit. Par rapport à ses concurrents externes, il est 2,2 fois plus rapide que GPT-OSS 120B d’OpenAI en débit d’inférence, et 7,5 fois plus rapide que Qwen3.5-122B d’Alibaba. Nous avons effectué notre propre test rapide. Le raisonnement a bien tenu, même sur des prompts volontairement vagues, mal formulés ou basés sur de fausses informations. Le modèle a détecté de petites erreurs dans le contexte sans qu’on lui demande, a géré proprement les problèmes mathématiques et logiques, et n’a pas sombré lorsque la question elle-même était légèrement incorrecte.

Le pipeline complet d’entraînement est public : poids sur Hugging Face, 10 trillions de tokens de pré-entraînement sélectionnés parmi 25 trillions au total durant l’entraînement, 40 millions d’échantillons post-entraînement, et recettes d’apprentissage par renforcement dans 21 configurations d’environnement. Perplexité, Palantir, Cadence et Siemens intègrent déjà le modèle dans leurs flux de travail. L’investissement de 26 milliards de dollars Le modèle pourrait faire partie d’une stratégie plus large. Un document financier de 2025 montre que Nvidia prévoit de dépenser 26 milliards de dollars au cours des cinq prochaines années pour développer des modèles d’IA open-weight. Les dirigeants l’ont confirmé aussi. Bryan Catanzaro, vice-président de la recherche en apprentissage profond appliqué, a déclaré à Wired que l’entreprise venait de terminer le pré-entraînement d’un modèle de 550 milliards de paramètres. Nvidia a publié son premier modèle Nemotron en novembre 2023, mais ce document montre que ce n’est plus un projet secondaire.

Cet investissement est stratégique, car les puces de Nvidia restent l’infrastructure par défaut pour entraîner et faire fonctionner des modèles de pointe. Les modèles optimisés pour son matériel offrent aux clients une raison intégrée de rester chez Nvidia, malgré les efforts de ses concurrents pour utiliser d’autres matériels. Mais il y a une pression plus urgente derrière cette démarche : l’Amérique perd la course à l’IA open-source, et rapidement. Selon des recherches d’OpenRouter et Andreessen Horowitz, les modèles open chinois sont passés de seulement 1,2 % de l’utilisation mondiale des modèles open à environ 30 % fin 2025. Alibaba’s Qwen a dépassé Llama de Meta en tant que modèle open-source auto-hébergé le plus utilisé, selon Runpod. Des entreprises américaines comme Airbnb l’ont adopté pour leur service client. Des startups du monde entier construisent dessus. Au-delà de la part de marché, cette adoption crée des dépendances infrastructurelles difficiles à inverser. Alors que des géants américains comme OpenAI, Anthropic et Google gardent leurs meilleurs modèles derrière des API, des laboratoires chinois comme DeepSeek ou Alibaba inondent l’écosystème open. Meta était le seul acteur américain majeur à concurrencer avec Llama, mais Zuckerberg a récemment laissé entendre que la société pourrait ne pas rendre ses futurs modèles entièrement open. L’écart entre “meilleur modèle propriétaire” et “meilleur modèle open” était autrefois énorme — et en faveur des États-Unis. Cet écart est désormais très réduit, et le côté open devient de plus en plus chinois.

Graphique incroyable. En seulement un an, la Chine a complètement dépassé les États-Unis dans les modèles d’IA gratuits.

Aucun modèle américain dans le top 5 aujourd’hui alors que l’année dernière, les 3 premiers étaient tous américains. pic.twitter.com/34ErpBv8rg

— Arnaud Bertrand (@RnaudBertrand) 14 octobre 2025

Il y a aussi une menace matérielle derrière tout cela. Un nouveau modèle DeepSeek devrait sortir bientôt, et il est supposé avoir été entièrement entraîné sur des puces fabriquées par Huawei — une entreprise chinoise sanctionnée. Si cela est confirmé, cela donnerait aux développeurs du monde entier, en particulier en Chine, une raison concrète de commencer à tester le matériel Huawei. La société chinoise Ziphu AI fait déjà cela. C’est le scénario que Nvidia doit surtout empêcher : que des modèles open chinois et des puces chinoises construisent un écosystème qui n’a pas besoin de Nvidia du tout.