Anthropic poursuivi en justice ! Accusation contre le gouvernement de Trump de représailles pour avoir bloqué Claude, 37 chercheurs en IA en soutien

Anthropic poursuit le gouvernement fédéral en justice, s’opposant à la classification comme risque de chaîne d’approvisionnement et à la suspension de Claude pendant 6 mois, alors que les controverses sur l’utilisation militaire de l’IA et la gouvernance de la sécurité s’intensifient.

Accusé d’être « risque de chaîne d’approvisionnement », Anthropic poursuit le gouvernement fédéral

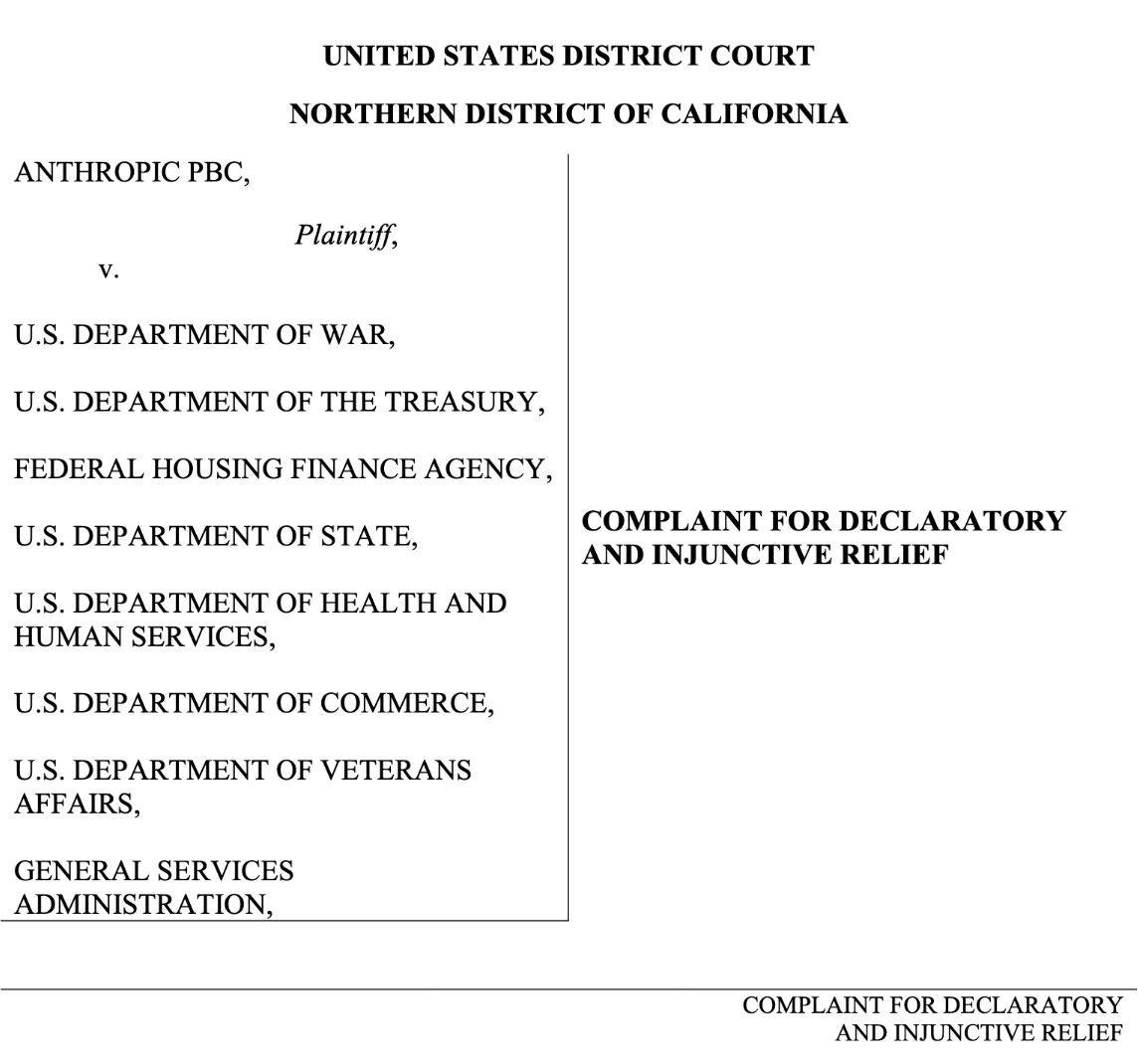

La société d’intelligence artificielle Anthropic a récemment intenté une action en justice devant un tribunal fédéral américain, accusant l’administration Trump de l’avoir classée parmi les « risques de chaîne d’approvisionnement » (supply chain risk) et demandant à toutes les agences fédérales de cesser d’utiliser ses systèmes d’IA. La société considère cette mesure comme une répression punitive. La plainte a été déposée devant le tribunal fédéral du district nord de la Californie.

Dans sa plainte, Anthropic indique que l’action du gouvernement manque de base légale et cause de graves perturbations à ses opérations et relations de partenariat. Les documents de la plainte désignent plusieurs agences et responsables gouvernementaux comme défendeurs, notamment le Département de la Défense, le secrétaire à la Défense Pete Hegseth, le secrétaire au Trésor Scott Bessent, le secrétaire d’État Marco Rubio, ainsi que le secrétaire au Commerce Howard Lutnick.

Source : Anthropic Anthropic poursuit le tribunal fédéral américain, accusant le gouvernement Trump de l’avoir classée comme « risque de chaîne d’approvisionnement » et demandant l’arrêt de l’utilisation de ses systèmes d’IA par les agences fédérales

L’étiquette « risque de chaîne d’approvisionnement » est généralement utilisée pour désigner des entreprises technologiques impliquées avec des pays hostiles, par exemple des fournisseurs pouvant contenir des logiciels espions ou malveillants. Anthropic souligne que classer une société américaine d’IA dans cette catégorie nuit gravement à sa réputation et à ses collaborations commerciales. Anthropic affirme que la société cherche à clarifier la légalité des actions du gouvernement par voie judiciaire, tout en protégeant ses intérêts, ceux de ses clients et partenaires.

Controverse sur l’utilisation militaire de l’IA, négociations sur les contrats d’IA militaire échouées

Le cœur de ce conflit réside dans le désaccord entre Anthropic et le Département de la Défense des États-Unis concernant l’utilisation de la technologie IA. Anthropic avait précédemment négocié un contrat d’une valeur maximale d’environ 200 millions de dollars avec le Pentagone. Au cours des négociations, le Département exigeait que le système d’IA puisse être utilisé dans tous les usages légaux, y compris dans des contextes militaires. Anthropic a insisté pour maintenir deux restrictions de sécurité :

- Interdire l’utilisation de son modèle Claude pour la surveillance de masse des citoyens américains ;

- Interdire son utilisation dans des systèmes d’armes létales entièrement autonomes.

La société considère que ces restrictions relèvent des principes fondamentaux de la gouvernance de la sécurité de l’IA. Les deux parties n’ont jamais réussi à s’accorder. En février 2026, le gouvernement américain a classé Anthropic comme « risque de chaîne d’approvisionnement » et a exigé que les agences fédérales cessent d’utiliser le système Claude dans un délai de 6 mois.

Dans sa plainte, Anthropic indique que le gouvernement utilise son pouvoir administratif pour faire pression sur l’entreprise, tentant de l’obliger à modifier sa politique de sécurité de l’IA. L’avocat de la société affirme que la Constitution américaine interdit au gouvernement de punir une entreprise en raison de ses positions publiques.

Lectures complémentaires

Sécurité nationale vs éthique : Anthropic refuse de retirer la barrière de sécurité de Claude, confrontation avec le Département de la Défense

Soutien de la communauté technologique, 37 chercheurs en IA déposent un avis auprès du tribunal

Le conflit entre Anthropic et le gouvernement a rapidement suscité des débats dans l’industrie technologique. Peu après le dépôt de la plainte, 37 chercheurs en intelligence artificielle issus d’OpenAI, Google et d’autres entreprises ont soumis un avis au tribunal, exprimant leur soutien à Anthropic. Ces chercheurs estiment que si le gouvernement punit une entreprise pour divergences sur la politique de sécurité de l’IA, cela pourrait affaiblir la compétitivité des États-Unis dans le secteur de l’intelligence artificielle.

L’avis indique que, si le gouvernement utilise la sécurité nationale comme prétexte pour réprimer les entreprises d’IA, cela pourrait avoir des effets à long terme sur l’industrie technologique et la recherche. Certains experts soulignent également que l’étiquette « risque de chaîne d’approvisionnement » est généralement réservée aux situations impliquant des préoccupations de sécurité logicielle étrangère. Le cas d’Anthropic ne correspond pas à ce type de risque.

Ben Goertzel, PDG de l’entreprise d’intelligence artificielle SingularityNET, déclare que refuser que l’IA soit utilisée pour la surveillance de masse ou pour des armes autonomes létales ne constitue pas une menace pour la sécurité. Si l’armée a besoin de telles applications, elle peut choisir d’autres systèmes d’IA.

Source : DigFin PDG de SingularityNET, Ben Goertzel

Conflit entre gouvernement et secteur technologique, débat sur la politique de l’IA s’amplifie

Face à la plainte, la Maison Blanche a rapidement réagi, affirmant que le gouvernement ne permettra pas aux entreprises de limiter l’accès de l’armée américaine à des technologies clés. Un porte-parole a précisé que le gouvernement américain doit s’assurer que l’armée peut utiliser les technologies nécessaires dans le cadre légal pour préserver la sécurité nationale.

Ce conflit soulève également des enjeux plus larges de politique technologique. L’administration Trump avait auparavant assoupli les restrictions à l’exportation de puces IA vers la Chine, tout en critiquant la position politique de certaines entreprises technologiques, ce qui a accru la tension entre la Silicon Valley et Washington.

Anthropic indique qu’après avoir été inscrit sur la liste noire, certaines entreprises ayant des partenariats avec le Département de la Défense pourraient devoir prouver que leurs systèmes n’utilisent pas Claude. Cette exigence pourrait avoir des répercussions en chaîne sur leurs collaborations commerciales.

Certaines grandes entreprises technologiques continuent de soutenir Anthropic. Google a déclaré qu’elle continuerait à fournir la technologie IA d’Anthropic à ses clients cloud, sans l’utiliser à des fins militaires. Microsoft et Amazon ont également affirmé qu’ils poursuivraient leur collaboration commerciale avec la société.

Anthropic a déposé une requête auprès du tribunal pour faire déclarer illégale l’action du gouvernement et pour suspendre l’application de la classification « risque de chaîne d’approvisionnement ». Après l’ouverture de la procédure judiciaire, le débat sur la gouvernance de la sécurité de l’IA, la sécurité nationale et l’autonomie des entreprises s’est intensifié.

Lectures complémentaires

OpenAI et la résistance militaire ! Téléchargement de Claude App dépasse la concurrence, enjeux éthiques et politiques derrière

Wall Street Journal : Après l’interdiction d’Anthropic par Trump, les États-Unis et Israël continuent de dépendre de Claude pour leurs opérations en Iran