Explication du discours de Vitalik à Hong Kong : analyse approfondie de la feuille de route d’Ethereum sur 5 ans et les raisons pour lesquelles zkVM, l’abstraction de compte et la sécurité résistante aux ordinateurs quantiques constituent les axes majeurs

1. Point clé : redéfinir le rôle d’Ethereum

Les propos de Vitalik à Hong Kong se résument ainsi : l’essence d’Ethereum ne consiste pas à être la « couche d’exécution la plus rapide », mais à servir de « tableau d’affichage public et de couche de calcul partagée ».

Cette définition, bien que pouvant paraître abstraite, modifie en profondeur le cadre d’analyse. Jusqu’à présent, le marché comparait souvent les blockchains publiques sur des critères comme le TPS ou la rapidité de confirmation, mais Vitalik met en avant une proposition de valeur différente :

-

Tableau d’affichage public : toute application peut publier des transactions, des hashes, des données chiffrées, etc., sur une couche publique, visible mondialement et vérifiable de manière séquentielle.

-

Couche de calcul partagée : les objets numériques sont gérés collectivement selon des règles de code, ce qui permet aux actifs, identités, mécanismes de gouvernance organisationnelle et collaborations de fonctionner sur une base de confiance commune.

En combinant ces deux capacités, Ethereum dépasse le cadre de la DeFi pour englober des « systèmes collaboratifs à forte valeur ajoutée » plus larges. Exemples :

-

Scénarios financiers nécessitant des enregistrements solides et vérifiables ;

-

Marchés de prédiction demandant une intégration entre actifs on-chain et informations off-chain ;

-

Systèmes de gouvernance et de vote nécessitant à la fois confidentialité et auditabilité.

Le message central : l’ambition d’Ethereum est de devenir une couche de base fiable à long terme pour le règlement et la collaboration sociétale, et non de remporter une course à la performance à court terme.

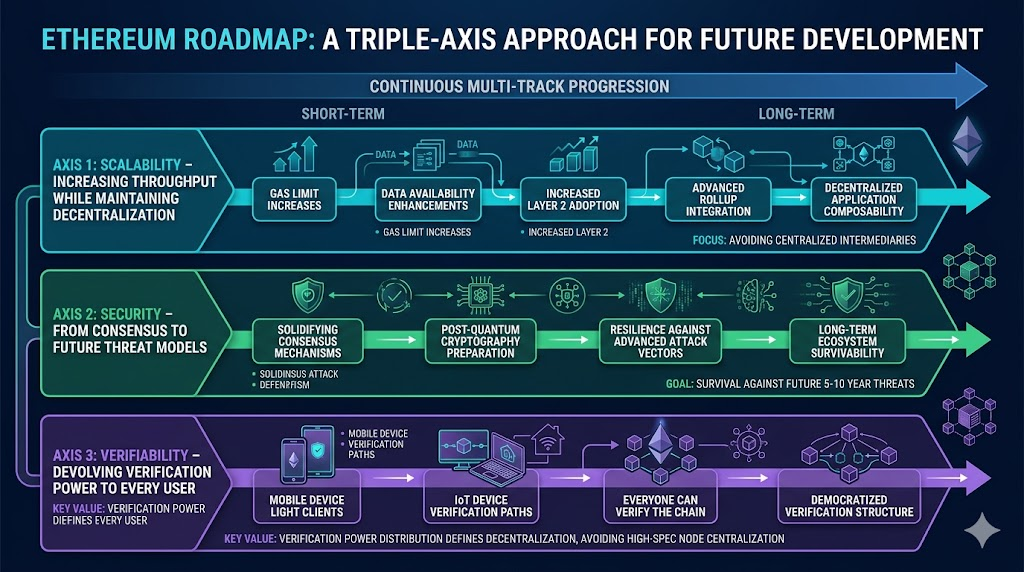

2. Priorité de la feuille de route : évolutivité, sécurité et vérifiabilité avancent ensemble

D’un point de vue structurel, Vitalik ne préconise pas une stratégie « d’abord l’échelle, puis la sécurité ». Il insiste sur la progression simultanée de trois priorités.

2.1 Mise à l’échelle : augmenter le plafond sans sacrifier la décentralisation

À court terme, les améliorations d’évolutivité se poursuivront, notamment par l’augmentation de la limite de gas et l’amélioration de la disponibilité des données. L’objectif n’est pas simplement « d’agrandir la chaîne », mais de permettre à davantage d’applications de se composer sans recourir à des intermédiaires centralisés.

2.2 Sécurité : élargir la sécurité du consensus aux modèles de menaces futurs

Vitalik a insisté sur la préparation post-quantique, marquant une évolution de la modélisation des menaces : passage des « surfaces d’attaque actuelles » aux « vecteurs d’attaque potentiels pour les 5 à 10 prochaines années ». Les objectifs de sécurité évoluent, allant de « prévenir les failles aujourd’hui » à « assurer la pérennité à long terme ».

2.3 Vérifiabilité : permettre à tous les appareils de vérifier

Vitalik a souligné que « tout le monde devrait pouvoir vérifier la chaîne », y compris les appareils mobiles et IoT.

Cela met en avant une valeur essentielle : la décentralisation n’est pas seulement une question de nombre de nœuds, mais de répartition du pouvoir de vérification. Si seuls quelques nœuds très performants peuvent vérifier, la structure politique et économique du système finit par se centraliser.

3. Cinq piliers techniques majeurs : zkVM, AA, confidentialité, post-quantique, expansion des données

L’intervention de Vitalik a mis en avant cinq axes techniques majeurs.

3.1 zkVM : faire de la « prouvabilité » une norme

La valeur stratégique de zkVM ne réside pas dans un simple saut de performance, mais dans la capacité à vérifier plus efficacement les résultats d’exécution de la chaîne. Si cette approche arrive à maturité, on verra :

-

Des appareils légers capables de vérifier, réduisant la dépendance des utilisateurs envers les nœuds tiers ;

-

Une compatibilité accrue entre évolutivité et décentralisation.

3.2 Account Abstraction (AA) : réinventer l’expérience et la sécurité du Wallet

L’abstraction de compte apporte plus de flexibilité aux transactions en dissociant la logique de vérification de la logique d’exécution, ce qui impacte directement :

-

L’adoption des Wallets Smart Contract ;

-

La mise sur le marché de fonctionnalités comme le parrainage de gas, les mécanismes de récupération et les stratégies multi-signature ;

-

L’intégration facilitée des signatures post-quantiques et des stratégies de confidentialité dans les Wallets.

Les Wallets deviendront ainsi des points d’accès programmables et sécurisés pour les utilisateurs, et non plus de simples conteneurs de clés privées.

3.3 Améliorations de la confidentialité : transparence on-chain et confidentialité utilisateur peuvent coexister

Vitalik l’a souligné : de nombreuses applications nécessitent intrinsèquement une « publication on-chain et une interprétation off-chain ».

La confidentialité n’est donc pas une option secondaire, mais une condition préalable à l’adoption massive des blockchains publiques.

Les axes futurs pourraient inclure :

-

Garantir des engagements et un ordre vérifiable on-chain ;

-

Protéger les informations sensibles off-chain via des protocoles cryptographiques ;

-

Offrir des interactions prouvables et minimales en exposition si nécessaire.

3.4 Signatures post-quantiques : se préparer dès maintenant, migrer ensuite

Vitalik a rappelé que les schémas de signature post-quantiques sont étudiés depuis des années, mais que l’efficacité et le coût restent des défis majeurs.

La question n’est plus « existe-t-il une solution », mais « peut-elle être déployée à grande échelle ».

À moyen et long terme, l’enjeu n’est pas seulement l’algorithme, mais la trajectoire de migration : comment faire évoluer le système de comptes actuel sans rupture.

3.5 Expansion des données : augmenter le plafond pour les applications on-chain et off-chain

Définir Ethereum comme une couche publique de publication de données fait de l’expansion des données une priorité d’infrastructure, pas une simple optimisation. Cela aura un impact direct sur la structure des coûts des L2, la composabilité et l’efficacité inter-protocoles.

4. Exigences réelles pour les couches L2 et Application : au-delà d’une « chaîne plus rapide »

La vision de Vitalik sur les L2 mérite une réflexion à l’échelle de l’industrie. L’essentiel : une L2 pertinente n’est pas une simple version accélérée d’une chaîne existante, mais un système où la coordination entre composants off-chain et frontières de sécurité on-chain est claire.

Cela implique de nouvelles attentes pour les équipes projet :

-

Identifier ce qui doit impérativement être on-chain et ce qui peut être off-chain ;

-

Expliquer comment les modules off-chain sont encadrés et vérifiés ;

-

Démontrer que les utilisateurs peuvent sortir, vérifier et conserver eux-mêmes leurs actifs même dans les pires scénarios.

Un focus exclusif sur le « moins cher et plus rapide » sans voies de sortie ou de vérification crédibles expose à un risque structurel de crédit.

5. Conseils pratiques pour développeurs, startups et investisseurs

Le discours de Vitalik propose des recommandations concrètes pour chaque acteur.

5.1 Pour les développeurs

-

Prioriser l’apprentissage des stacks AA et zk, pas seulement les couches d’interaction front-end ;

-

Concevoir les applications avec la vérifiabilité et des issues de secours par défaut ;

-

Traiter la confidentialité et le contrôle des permissions comme des enjeux d’architecture, pas comme des ajouts secondaires.

5.2 Pour les startups

-

Faire évoluer la stratégie produit du « cumul de fonctionnalités » vers « l’efficacité collaborative de confiance » ;

-

Privilégier des architectures avec séparation claire on-chain/off-chain, en évitant les opérations centralisées lourdes ;

-

Lors des levées de fonds, mettre l’accent sur la sécurité et la résilience réglementaire plutôt que sur le TPS.

5.3 Pour les investisseurs et chercheurs

À l’avenir, il faudra privilégier les acteurs qui garantissent la vérifiabilité, la sécurité et la souveraineté utilisateur, et non ceux qui ne parlent que d’évolutivité.

-

Lors de l’évaluation des projets, poser les questions suivantes :

-

Les utilisateurs peuvent-ils auto-vérifier les états clés ?

-

Une sortie sûre est-elle possible en cas d’extrême ?

-

Le protocole prévoit-il un plan de migration post-quantique ?

-

6. Risques et incertitudes : variables critiques entre vision et exécution

Aucune feuille de route ne garantit de résultats, surtout dans des systèmes complexes comme les blockchains publiques. Les principaux risques évoqués :

-

Complexité technique : zkVM, post-quantique et protocoles de confidentialité exigent une mise en œuvre et un audit rigoureux ;

-

Coordination de l’écosystème : clients, Wallets, applications, L2 et infrastructures nécessitent une collaboration sur le long terme ;

-

Formation des utilisateurs : la vérifiabilité ne rime pas automatiquement avec utilisabilité ; l’expérience utilisateur reste essentielle à l’adoption ;

-

Décalage des attentes du marché : les marchés de capitaux privilégient les indicateurs à court terme, alors que l’évolution des protocoles est un processus long.

Le cadre d’évaluation le plus robuste :

-

Court terme : respect des jalons ;

-

Moyen terme : taux d’adoption de l’écosystème ;

-

Long terme : fonctionnement durable même en cas de changement d’équipe centrale.

Conclusion : de la « course à la performance » à la « course à la confiance »

Source de l’image : Gate Market Page

La force du discours de Vitalik est de clarifier la vision à long terme d’Ethereum : il ne s’agit pas d’être la chaîne la plus rapide, mais de devenir la couche publique de confiance la plus solide.

À l’ère de l’IA, du calcul quantique et d’une régulation mondiale en mutation, les qualités les plus recherchées ne sont pas la vitesse à court terme, mais :

-

La vérifiabilité ;

-

La pérennité ;

-

La composabilité ;

-

L’évolution durable.

À l’horizon 2026, ce discours envoie un message clair : la compétition sur les blockchains publiques passe de « qui va le plus vite » à « qui inspire le plus confiance ». C’est ce critère qui déterminera quelle infrastructure soutiendra la prochaine vague d’applications à grande échelle.

Références : Foresightnews

Articles Connexes

Plasma (XPL) face aux systèmes de paiement traditionnels : une nouvelle approche du règlement transfrontalier et du cadre de liquidité pour les stablecoins

Quelles sont les différences fondamentales entre Solana (SOL) et Ethereum ? Analyse comparative des architectures de blockchain publique

Comment Midnight assure-t-il la confidentialité sur la blockchain ? Analyse des preuves à divulgation nulle de connaissance et des mécanismes de confidentialité programmables

Comment miser sur l'ETH?

La relation entre Midnight et Cardano : comment une sidechain axée sur la confidentialité élargit l’écosystème applicatif de Cardano