Si vous ne maîtrisez pas l’IA à l’issue de cette présentation, la décennie à venir risque de vous dérouter

La majorité des gens associe l’IA à un simple chatbot.

C’est compréhensible : on ouvre ChatGPT, on lui demande de corriger un e-mail, il s’exécute. Cela paraît magique. On repart avec le sentiment d’avoir compris le fonctionnement. Mais c’est comme régler une addition au restaurant avec une carte bancaire et penser saisir le modèle économique de Visa. Vous avez utilisé le produit, sans voir le système sous-jacent.

L’an passé, j’ai consacré beaucoup de temps à identifier les véritables flux financiers de l’IA. La réalité, c’est qu’il m’a fallu longtemps pour cesser de regarder au mauvais endroit. Je restais focalisé sur ChatGPT, Claude ou Gemini, sur la partie visible, alors que 700 milliards de dollars étaient injectés dans une infrastructure dont j’ignorais tout. Des puces inconnues, des technologies d’assemblage aux acronymes improbables, des systèmes de refroidissement, des centrales électriques et du béton coulé au Texas, dans l’Iowa ou à Hyderabad.

Il y a un an, personne dans mon entourage n’évoquait ces sujets. Aujourd’hui, tout le monde en parle.

Cet article est long. Si vous manquez de temps, mettez-le de côté et revenez plus tard. Je souhaite vous guider à travers toute la chaîne de valeur de l’IA, de l’électricité qui alimente les centres de données jusqu’à l’application sur votre téléphone, avec un discours accessible même sans expérience de lecture de rapports annuels.

Je clarifierai le jargon au fil du texte. J’illustrerai chaque point avec des chiffres réels. Et je resterai transparent sur les zones d’incertitude, car il y en a.

Entrons dans le vif du sujet.

I - Le gâteau à cinq couches (et pourquoi les quatre du bas restent invisibles)

L’IA est une infrastructure. Comme Internet, comme l’électricité, elle exige des usines. ~ Jensen Huang

La conception la plus répandue de l’IA est la suivante : un ordinateur intelligent qui répond aux questions.

C’est comme dire qu’Internet sert à « regarder des vidéos ». Ce n’est pas faux, mais cela passe à côté de l’essentiel.

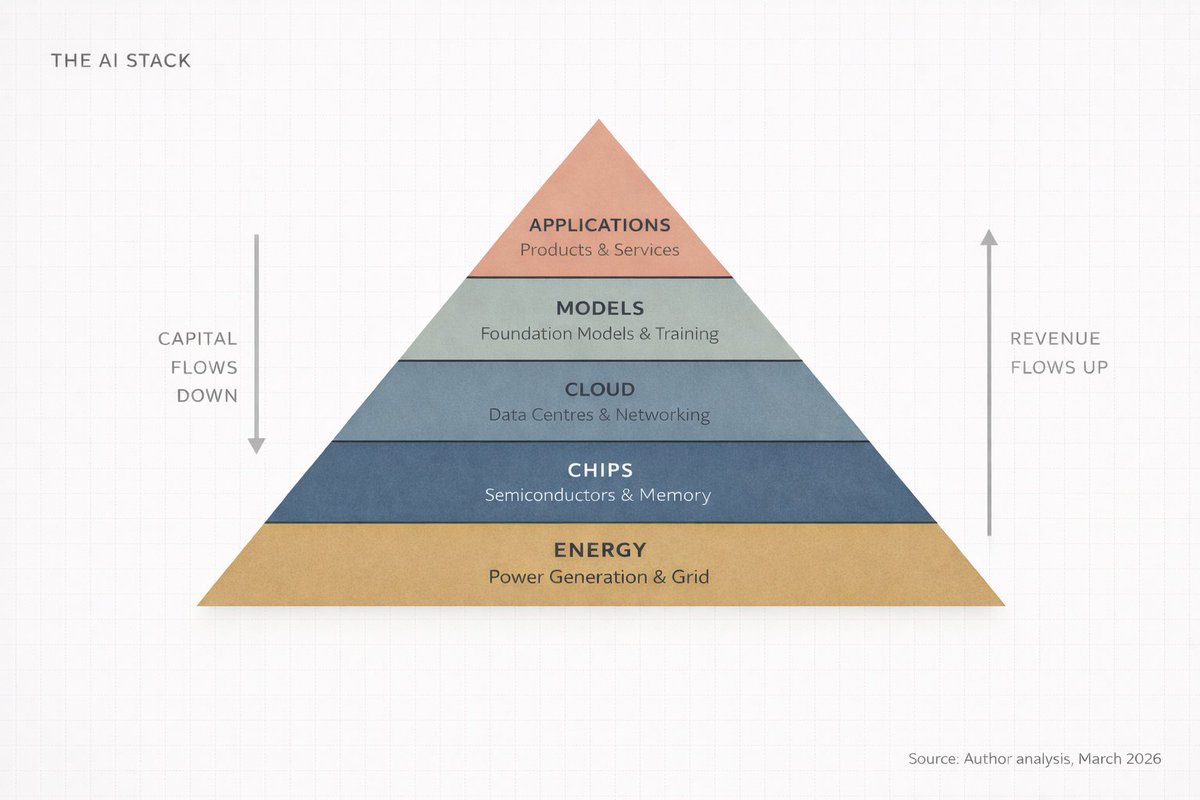

Jensen Huang, CEO de Nvidia, a présenté l’IA à Davos en janvier 2026 comme un système à cinq couches : énergie, puces, cloud, modèles, applications. Il a qualifié l’ensemble de « plus grand chantier d’infrastructure de l’histoire humaine ».

Pensez à ce mot : infrastructure. Routes, réseaux électriques, systèmes hydrauliques. Ces éléments fondamentaux font fonctionner la civilisation, et on n’y pense que lorsqu’ils font défaut. L’IA devient ce genre de pilier : invisible, indispensable, et d’un coût de construction colossal.

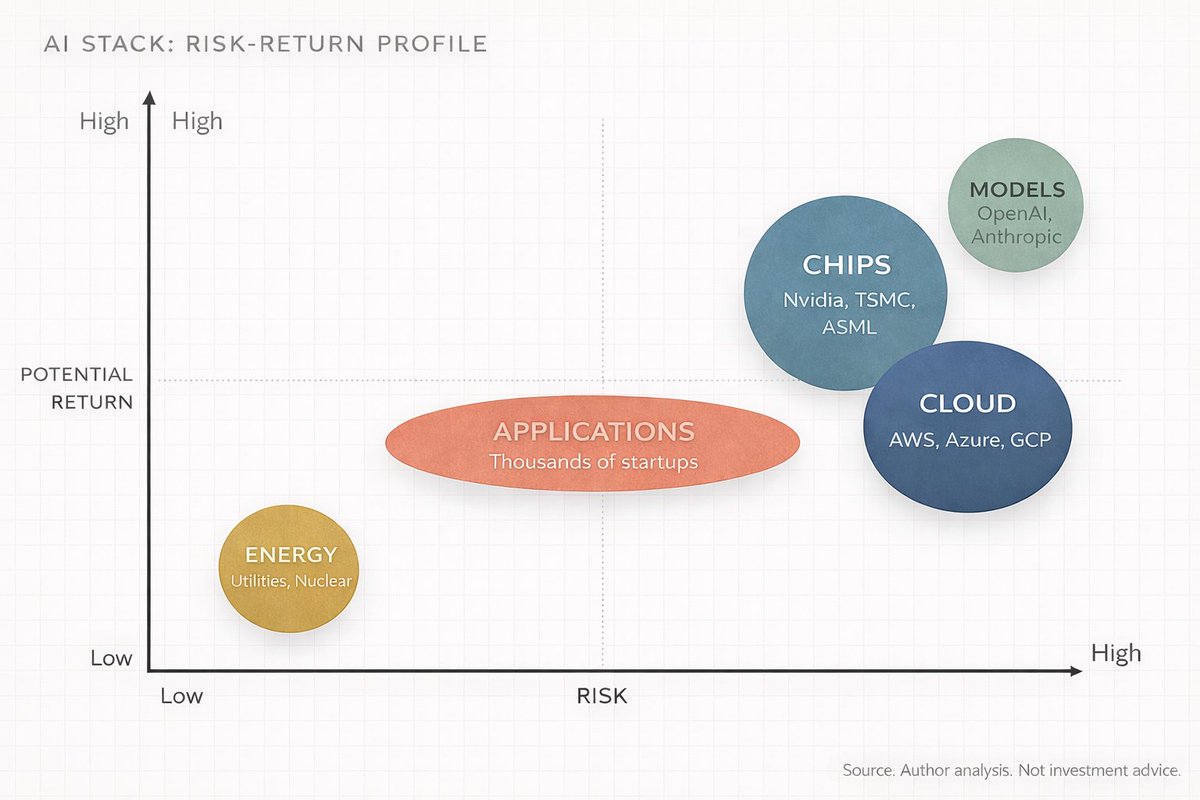

C’est ce que j’appelle la Stack IA : cinq couches superposées, chaque niveau alimentant le suivant, avec des flux financiers dans les deux sens.

La version la plus épurée :

- Énergie : il faut de l’électricité, en quantité, pour alimenter les ordinateurs.

- Puces : il faut des processeurs spécialisés pour effectuer les calculs. Rien à voir avec le processeur d’un ordinateur portable.

- Cloud : il faut des entrepôts géants remplis de ces puces, connectés par des réseaux ultra-rapides.

- Modèles : il faut le logiciel d’IA, le « cerveau » qui apprend à partir des données.

- Applications : il faut des produits concrets. ChatGPT, Google Search, le détecteur de fraude de votre banque.

Toute analyse de l’IA qui ne s’intéresse qu’à la couche 5 occulte 80 % de la réalité.

Et voici l’essentiel pour l’investisseur, l’entrepreneur ou l’observateur : l’argent ne circule pas uniformément entre ces couches. Il se concentre, il s’accumule. Aujourd’hui, il se concentre là où peu de gens regardent.

II - Suivez les flux financiers (ils ne sont pas là où on les attend)

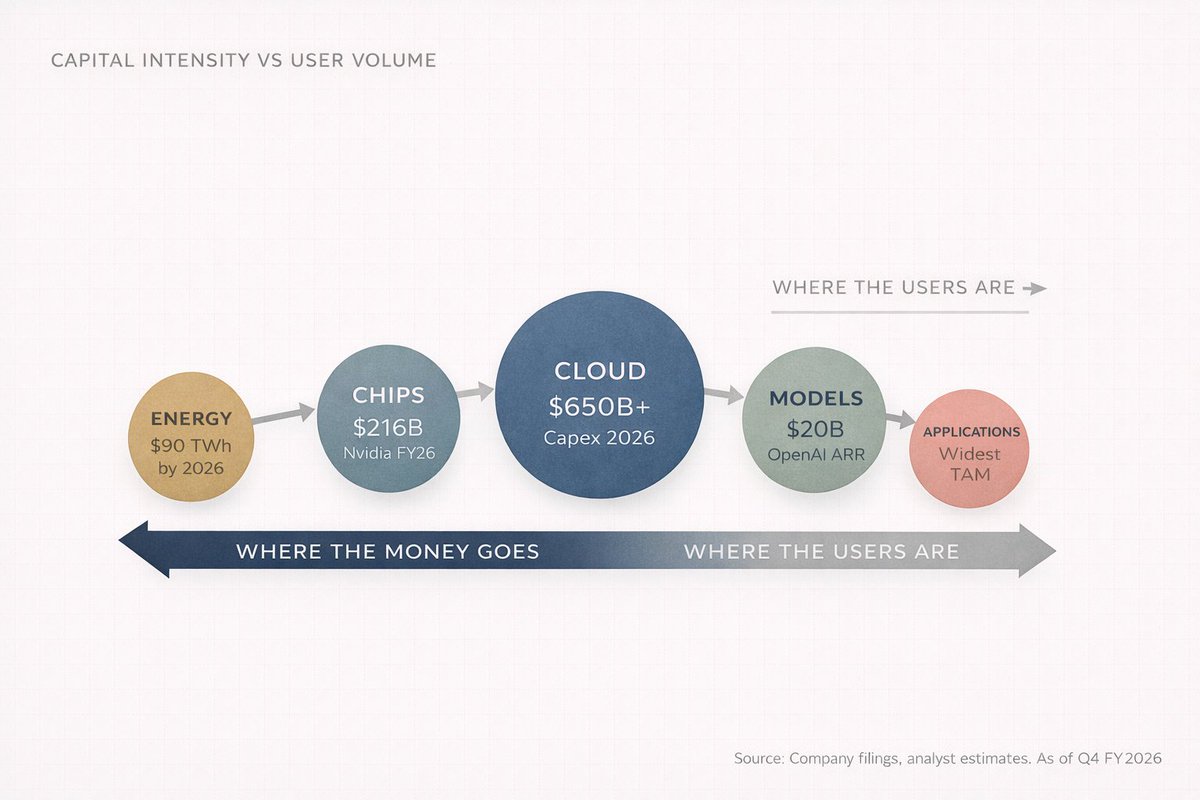

L’imaginaire collectif se focalise sur la couche application : ChatGPT, Copilot, Claude, Perplexity. Ce sont les produits tangibles, donc on croit qu’ils incarnent l’essentiel.

Mais voici ce que tout le monde néglige.

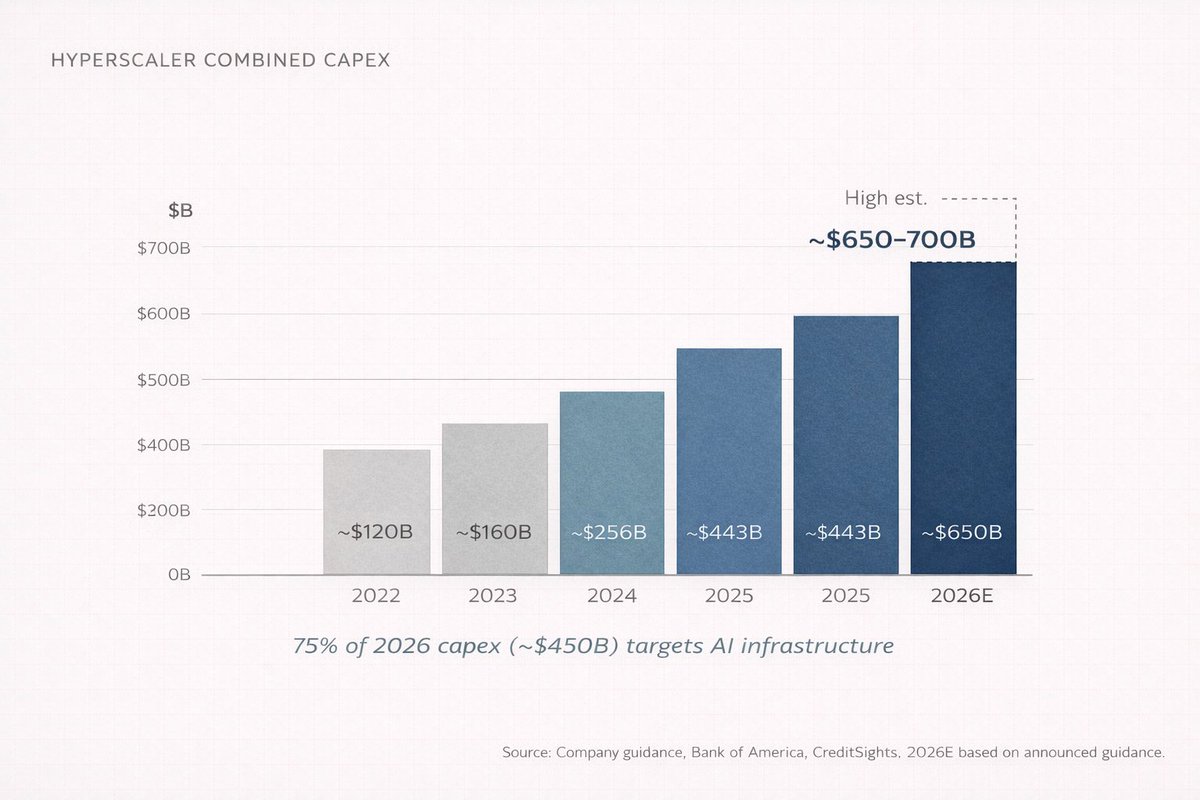

En 2026, les quatre plus grands acteurs du cloud (Amazon, Microsoft, Google, Meta) prévoient d’investir entre 650 et 700 milliards de dollars en dépenses d’investissement, soit l’équivalent du PIB suisse. Près de 75 % de cette somme, soit environ 450 milliards, seront directement affectés à l’infrastructure IA.

Pas dans les chatbots, ni dans les applications, mais dans les bâtiments, les puces, les câbles et les systèmes de refroidissement.

Personne n’en parle lors des soirées. C’est le signe que c’est là que se trouve l’argent.

Car avant d’utiliser ChatGPT, il faut bâtir un centre de données de la taille d’un centre commercial, l’équiper de dizaines de milliers de processeurs spécialisés, les relier avec un réseau valant plus que la plupart des entreprises, puis alimenter le tout avec assez d’électricité pour une petite ville. Chaque jour.

C’est la couche 1 à 3 : les couches invisibles, là où le capital s’investit massivement.

« Et OpenAI ? Ils ne gagnent pas des milliards ? »

Oui. OpenAI a atteint 20 milliards de dollars de revenus récurrents annualisés fin 2025, contre 6 milliards l’année précédente et 2 milliards l’année d’avant. Une multiplication par dix en deux ans, du jamais vu.

Mais il y a un revers : OpenAI a brûlé près de 9 milliards de cash en 2025 et prévoit 17 milliards de cash burn pour 2026. Le coût d’inférence (exécution de l’IA à chaque question) a atteint 8,4 milliards en 2025 et devrait grimper à 14,1 milliards en 2026. L’équilibre de trésorerie n’est pas attendu avant 2029 ou 2030.

Où va tout ce cash brûlé ?

Il descend dans la stack : vers Microsoft Azure (OpenAI reverse 20 % de ses revenus à Microsoft jusqu’en 2032), vers Nvidia pour les puces, vers les constructeurs et équipementiers de data centres, vers les producteurs d’électricité.

Le système est presque circulaire : Microsoft investit dans OpenAI, OpenAI dépense chez Azure, Azure achète plus de puces Nvidia, NVIDIA annonce des records, et l’argent continue de descendre.

La plupart des utilisateurs sont en haut de la stack, la majorité des profits en bas. Cette dissymétrie est fondamentale.

Première leçon de la chaîne de valeur IA : les revenus montent, le capital descend.

III - Ce scénario s’est déjà produit

Tous les problèmes de l’humanité sont des problèmes d’ingénierie, et l’ingénierie apporte des solutions. ~ Buckminster Fuller

Pour comprendre l’IA, il faut observer l’évolution de l’électricité entre 1880 et 1920.

Quand Edison lance la première centrale commerciale en 1882 à Manhattan, l’électricité est vue comme une curiosité. Pourquoi s’y intéresser alors que les lampes à gaz fonctionnent ?

En 40 ans, l’électricité a bouleversé toutes les industries. Les vainqueurs n’étaient pas les inventeurs de l’ampoule, mais ceux qui construisaient les centrales, posaient les câbles, fabriquaient les générateurs : General Electric, Westinghouse, les sociétés de services publics, les exploitants de cuivre, les constructeurs.

Le même schéma se répète avec l’IA, mais sur quelques années.

IA → data centres → puces → matières premières → énergie

Électricité → usines → machines → matières premières → charbon/eau

L’ordre est quasi identique. Et la valeur se concentre sur l’infrastructure, pas sur l’application.

C’est ce que j’appelle la gravité de l’infrastructure. À chaque nouvelle plateforme informatique, la création de richesse commence par l’outillage. Les applications arrivent ensuite, font la une, mais l’infrastructure capte la marge.

NVIDIA a généré 215,9 milliards de dollars de chiffre d’affaires sur l’exercice 2026 (+65 %), dont 62,3 milliards pour la division data centres au dernier trimestre (+75 %). Ce segment pèse plus de 91 % du total. Imaginez : 68 milliards sur un trimestre, neuf dollars sur dix venant d’une seule activité.

TSMC, qui fabrique les puces Nvidia et bien d’autres, détient près de 70 % du marché mondial des fonderies en 2025 (122,5 milliards de ventes). Samsung suit à 7,2 %. Un niveau de domination rare.

L’infrastructure gagne toujours en premier. La question est : combien de temps la fenêtre reste-t-elle ouverte ?

Demandez ce qu’a été la révolution Internet, on citera Google, Amazon, Facebook. Mais l’argent s’est d’abord fait chez Cisco, Corning, et les poseurs de fibre. Même logique, autre décennie.

IV - Ce que personne ne veut entendre

La Bourse transfère l’argent des impatients vers les patients. ~ Charlie Munger

Soyons honnête. Quand j’ai commencé à m’intéresser à l’IA comme investisseur, j’ai commis la même erreur que beaucoup.

J’ai regardé la couche application : ChatGPT grandit, Anthropic lève des milliards. J’ai pensé : les entreprises IA vont gagner, investissons dans l’IA.

Trois éléments m’ont fait changer d’avis, dans cet ordre :

D’abord, j’ai constaté que presque toutes les « entreprises IA » brûlaient du cash : OpenAI, Anthropic, Mistral, xAI. Non parce qu’elles sont mal gérées, mais parce que les coûts informatiques sont structurels. Chaque question posée à un modèle IA coûte de l’argent. Plus le modèle est performant, plus il consomme, donc plus il coûte cher à faire tourner.

Les « gagnants » de l’IA sont ceux qui dépensent le plus.

Ensuite, j’ai vu que les entreprises d’infrastructure affichaient des marges inédites depuis les débuts de Google : 75 % de marge brute chez NVIDIA, TSMC augmente capacités et prix simultanément. Ces entreprises n’ont pas de problème de monétisation, mais de capacité de production.

Enfin, j’ai compris que je pensais l’IA en consommateur, pas en ingénieur. Le consommateur voit l’application, l’ingénieur la stack.

Quand on voit la stack, tout change.

Chaque annonce IA devient une annonce d’investissement. Chaque amélioration de modèle, une commande de puces. Chaque nouvelle fonctionnalité, un bail de data centre. L’industrie ressemble à des cercles concentriques, et plus on s’approche du centre, plus les profits sont concentrés.

Vous êtes peut-être ingénieur, investisseur Nvidia, ou simple observateur. Le principe est le même : le consommateur voit le produit, l’investisseur la chaîne d’approvisionnement. Les meilleurs voient la chaîne avant même l’arrivée du produit.

Rétrospectivement, cela semble évident, mais il m’a fallu du temps pour changer de paradigme. J’ai dû désapprendre les réflexes SaaS, où la valeur se concentrait sur l’application. Je cherchais le « prochain OpenAI » alors qu’il fallait regarder à qui OpenAI signait des chèques. L’IA diffère structurellement du SaaS : les besoins en calcul sont tels que l’infrastructure capte plus de valeur, du moins à ce stade.

Comprendre la stack change la lecture des actualités, l’analyse des entreprises, la stratégie d’allocation.

Je publierai d’autres analyses de ce type sur l’investissement, l’IA et les systèmes de création de richesse. Si vous souhaitez lire la suite, abonnez-vous et activez les notifications.

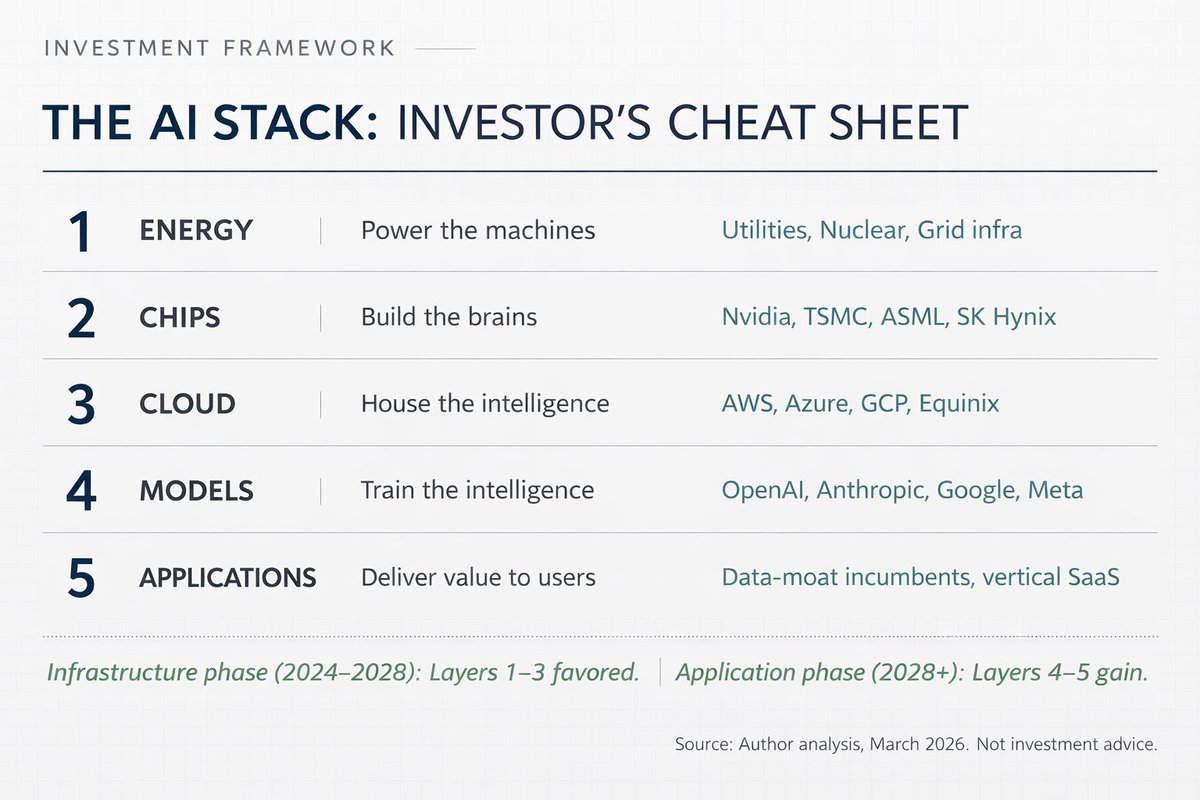

V - Cartographie de l’investisseur : analyse couche par couche

C’est long, donc j’accélère. Voici le détail de chaque couche de la Stack IA : fonctionnement, acteurs, opportunités d’investissement.

Restez concentré.

Couche 1 : Énergie

Les data centres IA sont extrêmement énergivores. Un entraînement IA de grande ampleur consomme autant d’électricité qu’une petite ville en un an. D’ici 2026, ces installations devraient consommer environ 90 térawattheures par an, soit dix fois plus qu’en 2022.

Thèse d’investissement limpide : ceux qui produisent, transportent et livrent une électricité fiable aux data centres en profiteront. Nucléaire, gaz naturel, énergies renouvelables à proximité des pôles de data centres. Fournisseurs d’électricité disposant d’un surplus de capacité. Constructeurs d’infrastructures réseau.

Jensen Huang l’a résumé en octobre 2025 : « L’autoproduction d’électricité par les data centres pourrait aller plus vite que le raccordement au réseau. » Les acteurs tech construisent déjà des centrales dédiées reliées directement à leurs data centres, contournant le réseau. Cela m’a surpris : ces entreprises deviennent leur propre fournisseur d’énergie.

Bénéficiaires : fournisseurs d’électricité (notamment nucléaire), producteurs indépendants, fabricants de transformateurs, d’appareillage, d’infrastructures électriques. En Inde, les sociétés d’équipements et de transmission profiteront de l’expansion des campus hyperscale en Asie.

Couche 2 : Puces

La plus connue grâce à Nvidia, mais la réalité est plus complexe.

La couche puces comporte plusieurs sous-couches, chacune avec sa dynamique concurrentielle. Tout en haut, les concepteurs : Nvidia (GPU), AMD (GPU/CPU), Broadcom (ASIC sur mesure), Qualcomm, et de plus en plus les hyperscalers (TPU de Google, Trainium d’Amazon, Maia de Microsoft). Ensuite, les fabricants : TSMC domine la fabrication (près de 70 % du marché mondial des fonderies), Samsung suit à 7,2 %. Intel tente de relancer son activité fonderie, mais la réussite n’est pas garantie.

Puis viennent les équipementiers, qui fabriquent les machines produisant les puces. ASML est le seul fabricant mondial de machines de lithographie EUV. Applied Materials, Lam Research et Tokyo Electron sont également présents. En dessous, la mémoire (SK Hynix, Samsung, Micron) et l’assemblage avancé (packaging comme la technologie CoWoS de TSMC, devenu un goulot d’étranglement).

La concentration ici est frappante : Nvidia détient environ 92 % du marché des GPU IA pour data centres. TSMC fabrique les puces de tous les grands concepteurs. ASML est le seul fournisseur mondial de machines EUV.

Une entreprise conçoit, une autre fabrique, une autre fournit la machine. Ce niveau de concentration est à la fois une opportunité et un risque géopolitique.

Couche 3 : Cloud et data centres

C’est là que résident les puces. D’immenses installations pleines de serveurs, reliées par des réseaux haut débit, refroidies par des systèmes thermiques sophistiqués (le refroidissement liquide devient la norme).

Le marché est dominé par trois hyperscalers : Amazon Web Services (31 %), Microsoft Azure (24 %), Google Cloud (11 %). Oracle vise 50 milliards de dollars de capex pour 2026.

Mais la couche cloud va plus loin : Foxconn assemble 40 % des serveurs IA mondiaux. Arista Networks et Credo Technology (action +117 % en 2025 grâce au transfert de données efficient) bâtissent l’infrastructure réseau. Vertiv gère le refroidissement liquide. Les foncières Equinix et Digital Realty détiennent les terrains et bâtiments. Chaque couche a sa propre chaîne d’approvisionnement.

En 2026, les hyperscalers consacrent 90 % de leur cash-flow opérationnel au capex (contre 65 % en 2025). Morgan Stanley prévoit plus de 400 milliards de dollars de dettes cette année pour financer la construction, soit plus du double de 2025. Ce chiffre m’a marqué : 400 milliards de dettes en un an pour bâtir des entrepôts informatiques.

Couche 4 : Modèles

C’est la couche « cerveau ». Les entreprises qui entraînent et développent les modèles IA.

Les grands noms : OpenAI (série GPT, plus de 20 milliards de dollars de revenus annualisés), Anthropic (Claude, environ 19 milliards début 2026), Google DeepMind (Gemini), Meta AI (Llama, open source), Mistral, xAI (Grok).

Cette couche est à la fois la plus médiatisée et la moins rentable. OpenAI affiche une croissance inédite, mais brûle 17 milliards de cash en 2026. Anthropic dépend de levées massives (5 milliards à une valorisation de 170 milliards début 2026).

Le problème est structurel : les modèles progressent à mesure que l’on investit dans la puissance de calcul, mais cette dépense croît plus vite que les revenus. C’est comme un restaurant où chaque plat coûte plus cher à produire, mais où le client attend le même prix. Les marges restent comprimées. Je ne sais pas quand cela changera.

Pour l’investisseur, cette couche est à haut risque, fort potentiel. La plupart de ces entreprises sont privées. L’exposition en Bourse se fait via les fournisseurs cloud (Microsoft détient une part d’OpenAI et héberge ses calculs sur Azure) et via les fabricants de puces.

Couche 5 : Applications

C’est la couche visible au quotidien : ChatGPT, Google Search (Gemini), Microsoft Copilot, détection de fraude bancaire par IA, recommandations Netflix, amélioration photo sur smartphone.

La couche application est la plus vaste et la plus concurrentielle. Des milliers de start-ups et grands groupes y travaillent. Elle deviendra sans doute la plus grande par le marché adressable (plus de 2 000 milliards estimés pour les années 2030), mais c’est aussi celle où les marges sont les plus faibles et l’incertitude la plus forte.

La différence se fait sur la donnée. Les entreprises disposant de données propriétaires auront un avantage durable : Salesforce (CRM), Bloomberg (données financières), Epic (dossiers médicaux). Ces entreprises peuvent affiner leurs modèles IA de façon inaccessible à un chatbot générique.

Pour l’investisseur, la couche application offre le plus grand potentiel de hausse, mais aussi le plus grand risque de destruction de capital. La plupart des start-ups IA échoueront, les survivantes croîtront vite.

Les meilleurs rendements sur 3 à 5 ans ? Infrastructure aujourd’hui, applications plus tard. Les capitaux avisés sont déjà positionnés.

Les gagnants de la couche 5 seront ceux qui possèdent des données inaccessibles aux autres. Et beaucoup ne se définissent même pas comme des entreprises IA.

VI - « N’est-ce pas une bulle ? »

Le principal problème de l’investisseur, et son pire ennemi, c’est probablement lui-même. ~ Benjamin Graham

Allons droit au but.

« Et la bulle Internet ? N’est-ce pas la même chose ? Dépenses massives en infrastructure, pas de profits, emballement général ? »

Voici la différence : à l’ère dot-com, les entreprises investissaient dans une infrastructure pour une demande inexistante. Elles posaient de la fibre et des serveurs pour un public encore en bas débit. L’infrastructure était prête, mais la demande n’est arrivée que 5 à 7 ans plus tard, tout le reste a été liquidé.

En 2026, la demande IA est déjà là. NVIDIA ne produit pas assez vite, TSMC n’a plus de capacité d’assemblage, les prix du cloud montent. OpenAI a ajouté 400 millions d’utilisateurs actifs hebdomadaires entre mars et octobre 2025. Les modèles sont utilisés, la puissance de calcul consommée, les clients paient.

Cela ne veut pas dire qu’il n’y a pas de risque. Il y en a, et j’y pense beaucoup. Trois points :

D’abord, la mauvaise allocation du capital. Les entreprises dépensent plus de 650 milliards en data centres en 2026. Si les revenus IA n’arrivent pas assez vite, les marges s’effondreront. Le free cash flow d’Amazon pourrait devenir négatif cette année. Amazon, inventeur du cloud.

Ensuite, le risque de concentration. La chaîne IA est dangereusement concentrée : TSMC fabrique près de 70 % des puces mondiales, ASML est le seul fournisseur de machines EUV, NVIDIA conçoit 92 % des GPU IA pour data centres. Un incident (géopolitique, catastrophe naturelle, concurrence) peut paralyser la stack. Un séisme à Hsinchu, Taïwan, pourrait retarder l’IA mondiale de plusieurs années.

Enfin, la question DeepSeek. En janvier 2025, le laboratoire chinois DeepSeek a publié un modèle performant pour une fraction du coût. Cela remet en cause l’idée que plus de dépenses égalent meilleure IA. Si les modèles open source et efficients progressent, la thèse d’investissement dans l’infrastructure s’affaiblit. Je ne pense pas que DeepSeek ait invalidé la thèse, mais cela introduit une nouvelle variable.

Le cadre à retenir : McKinsey estime que l’investissement cumulé dans les data centres pourrait atteindre 6 700 milliards de dollars d’ici 2030. PwC estime que l’IA pourrait ajouter 15 700 milliards au PIB mondial d’ici 2030. IDC prévoit 22 300 milliards d’impact cumulé des solutions IA d’ici 2030.

Même si ces chiffres sont erronés de 50 %, il s’agit du plus grand basculement économique depuis Internet. La question est celle de l’ampleur, pas de la direction.

On entend souvent « Je suis sceptique sur l’IA ». C’est légitime pour les modèles ou les délais, mais ne soyez pas ignorant de la chaîne d’approvisionnement. L’un est une posture intellectuelle saine, l’autre coûte de l’argent.

Dans cinq ans, les vainqueurs de ce cycle paraîtront évidents. Le jeu, aujourd’hui, c’est de comprendre la structure avant les autres.

VII - Jouer au bon niveau

Considérez l’IA comme un jeu vidéo à cinq niveaux superposés.

Niveau 1 (Énergie) : le tutoriel. Essentiel, discret, quasi impossible à perdre. Risque faible, rendement stable.

Niveau 2 (Puces) : le boss. Concentration maximale, marges élevées, mais aussi le plus exposé aux risques et disruptions. Récompenses massives, difficulté élevée.

Niveau 3 (Cloud) : le serveur multijoueur. Tout le monde y joue, les hyperscalers sont les administrateurs, ils prélèvent leur commission.

Niveau 4 (Modèles) : l’arène PvP. Compétition féroce, innovation rapide, la plupart des joueurs sont éliminés.

Niveau 5 (Applications) : le monde ouvert. Possibilités infinies, mais aucun butin garanti.

La stratégie est simple : inutile de jouer sur tous les niveaux. La plupart visent le niveau 5 car il est visible. L’argent malin exploite les niveaux 2 et 3, là où l’expérience est maximale.

Votre place dans la stack détermine votre angle d’approche.

Pour les non-techniciens : inutile de comprendre le fonctionnement d’un GPU, mais il faut savoir que quelqu’un le fabrique, l’héberge, l’alimente. Et ces acteurs sont cotés en Bourse.

Pour les techniciens, vous savez que les modèles progressent, mais vous sous-estimez peut-être la rapidité avec laquelle les contraintes physiques (énergie, refroidissement, packaging) deviennent le goulot d’étranglement. La prochaine décennie de progrès IA se jouera sur l’ingénierie, pas sur les architectures.

Pour l’investisseur, la chaîne de valeur IA, c’est cinq paris empilés, chacun avec son profil risque/rendement, son horizon, ses vainqueurs. Traiter « l’IA » comme un secteur unique, c’est comme traiter « la technologie » comme un secteur unique en 1998. L’écart de performance au sein de l’IA est immense.

Cela ne durera pas éternellement. L’infrastructure atteindra la maturité, la couche application se consolidera, et la valeur remontera dans la stack, comme avec Internet. Amazon, Google, Facebook (la couche application d’Internet) ont fini par capter plus de valeur que les câbliers ou assembleurs de serveurs.

Mais nous sommes encore dans la phase infrastructure, la phase outillage. Et l’outillage génère d’énormes profits.

Ceux qui comprennent la stack entière verront les transitions avant les autres. Les autres seront surpris, encore et encore, par la destination réelle de l’argent.

Dans 10 ans, comprendre la stack IA sera aussi fondamental que lire un bilan.

Apprenez la stack. Cartographiez les couches. Suivez les flux financiers.

C’est ça, le jeu.

~ Anish Moonka

Avertissement :

-

Cet article est une republication de [AnishA_Moonka]. Tous droits réservés à l’auteur original [AnishA_Moonka]. Pour toute objection à cette republication, veuillez contacter l’équipe Gate Learn qui traitera votre demande dans les meilleurs délais.

-

Clause de non-responsabilité : les opinions exprimées dans cet article sont celles de l’auteur et ne constituent pas un conseil en investissement.

-

Les traductions de cet article dans d’autres langues sont réalisées par l’équipe Gate Learn. Sauf mention contraire, la copie, la distribution ou le plagiat des articles traduits sont interdits.

Articles Connexes

Analyse des sources de rendement USD.AI : comment les prêts destinés à l’infrastructure IA génèrent du rendement

USD.AI Tokenomics : analyse approfondie des cas d’utilisation du token CHIP et des mécanismes d’incitation

Render, io.net et Akash : analyse comparative des réseaux DePIN de taux de hachage

Comment trader grâce à des compétences en crypto : de la conception de la stratégie à l’exécution automatisée

L’application de Render dans l’IA : comment le taux de hachage décentralisé dynamise l’intelligence artificielle