Les résultats de recherche de Bing AI seraient compromis : des pirates informatiques ont développé de faux installateurs OpenClaw afin de voler des actifs crypto, mettant en lumière les risques de sécurité associés à la recherche propulsée par l’intellige

Synthèse de l’événement : Soupçon d’empoisonnement des résultats de recherche Bing AI

Source de l’image : https://x.com/im23pds/status/2031163246783410581

Source de l’image : https://x.com/im23pds/status/2031163246783410581

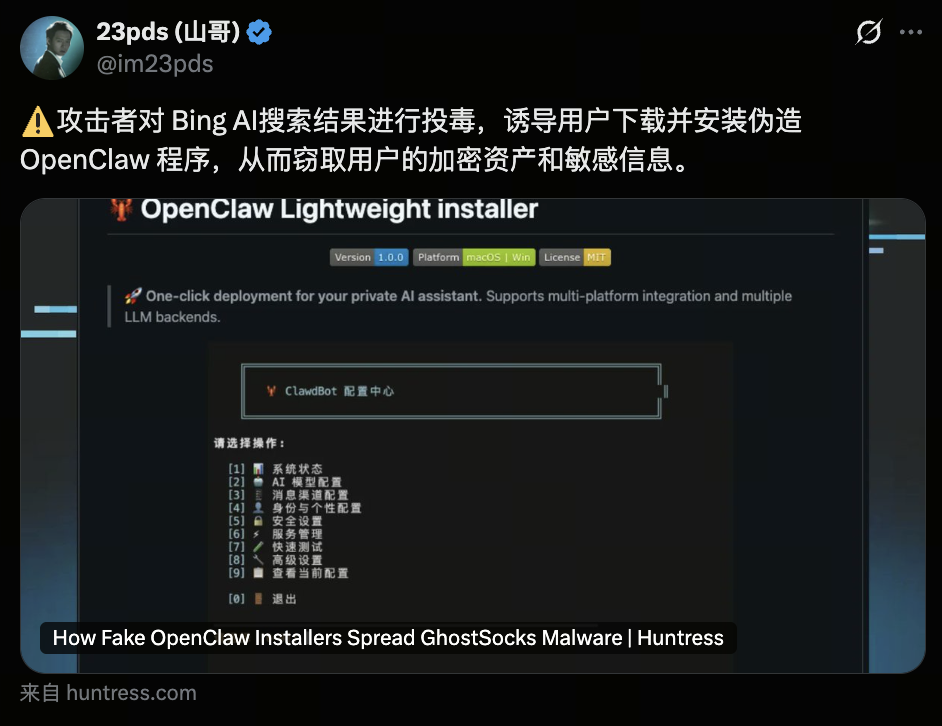

En mars 2026, le responsable de la sécurité de la société spécialisée dans la sécurité blockchain SlowMist a publié une alerte publique, signalant que des acteurs malveillants auraient manipulé les résultats de Bing AI par le biais de techniques d’« empoisonnement de recherche ». Ces attaquants incitaient les utilisateurs à télécharger une version contrefaite d’OpenClaw, permettant le vol de crypto-actifs et de données sensibles.

L’« empoisonnement de recherche » consiste pour des cybercriminels à créer des sites ou dépôts spécifiquement optimisés pour remonter dans les résultats des moteurs de recherche. Lorsqu’un utilisateur saisit des mots-clés ciblés, ces ressources malicieuses apparaissent en tête des recommandations, voire sont citées directement par les moteurs dotés d’intelligence artificielle.

Dans ce cas précis, une recherche contenant les mots-clés « OpenClaw Windows » amenait Bing AI à recommander un dépôt GitHub frauduleux comme source de téléchargement. Après installation, certains appareils étaient infectés par un malware voleur d’informations.

Des experts en cybersécurité ont ensuite confirmé la suppression du dépôt et de l’installeur malveillants. Toutefois, cet incident a suscité un vif débat sur la sécurité des recherches IA et la protection des crypto-actifs.

OpenClaw : définition et raisons de l’attaque

Source de l’image : Site officiel OpenClaw

Source de l’image : Site officiel OpenClaw

OpenClaw est un outil open source qui connaît une popularité croissante auprès des communautés développant des agents IA et des solutions d’automatisation. Il sert principalement à concevoir des agents, à automatiser des processus et à constituer des chaînes d’outils à destination des développeurs.

L’adoption rapide de ces frameworks d’agents IA amplifie l’essor de l’écosystème, suscitant l’intérêt des cybercriminels pour plusieurs raisons :

- Confiance des développeurs dans l’open source : Les professionnels du secteur téléchargent habituellement leurs outils et codes sur GitHub.

- Droits élevés requis par les outils IA : Nombre de solutions IA nécessitent l’accès aux fichiers système, aux clés API ou à des identifiants cloud.

- Forte corrélation avec les utilisateurs de crypto : Les développeurs IA, Web3 et les investisseurs en actifs numériques se confondent souvent.

En conséquence, la distribution de faux installeurs OpenClaw permet aux attaquants de cibler directement des appareils hébergeant des clés privées de portefeuilles, des comptes de trading ou des clés API.

Schéma d’attaque : de l’empoisonnement de recherche à la propagation de malwares

Falsification de dépôt GitHub et exploitation de la confiance communautaire

Les chercheurs ont mis au jour la création d’une organisation GitHub baptisée « openclaw-installer » par les attaquants, y publiant des dépôts à l’apparence légitime.

Afin de renforcer la crédibilité, ils ont copié une partie du code source du projet officiel, rendant l’architecture du dépôt très convaincante.

La réputation de GitHub, alliée au poids des recommandations issues de l’IA, a conduit nombre d’utilisateurs à penser que le dépôt était authentique.

Le déroulement de l’attaque est le suivant :

- L’utilisateur recherche OpenClaw via Bing AI

- L’IA recommande le dépôt GitHub frauduleux

- L’utilisateur télécharge le faux installeur

- Le code malveillant exécute silencieusement des opérations de vol d’informations

Ce mode opératoire mise sur la confiance dans l’open source et la recommandation IA, augmentant fortement son efficacité.

Charges malicieuses adaptées à Windows et macOS

Les investigations révèlent que les attaquants ont conçu des charges différentes selon le système.

Pour Windows :

- Diffusion d’un installeur factice intitulé OpenClaw_x64.exe

- Exécution en mémoire du stealer Vidar

- Installation simultanée du trojan GhostSocks assurant un contrôle à distance

Pour macOS :

- Fourniture de fausses instructions d’installation

- Incitation à exécuter des commandes Bash dans le Terminal

- Téléchargement et installation du malware Atomic Stealer

Ces programmes ciblent prioritairement :

- Les mots de passe de navigateur

- Les clés de portefeuilles crypto

- Les clés SSH

- Les jetons API

- Les identifiants Telegram/Discord

Une fois ces données dérobées, les attaquants s’emparent rapidement des actifs numériques de la victime.

Recherche IA et SEO poisoning : nouvel horizon des cyberattaques

Si l’empoisonnement de recherche n’est pas inédit, la montée en puissance de la recherche IA accentue ses effets. Les cybercriminels manipulent contenu web, structure des dépôts ou mots-clés pour placer leurs ressources malveillantes en tête des résultats.

La recherche IA présente des risques aggravés :

- L’IA synthétise et recommande activement du contenu

- La confiance des utilisateurs envers les recommandations IA est élevée

- Les liens proposés échappent parfois aux filtres classiques des moteurs de recherche

Les analystes soulignent que le simple hébergement de code malicieux sur un dépôt légitime suffit parfois à le faire remonter dans les recommandations.

La combinaison recherche IA + open source s’impose ainsi comme un vecteur d’attaque central.

Conséquences pour l’industrie crypto et l’écosystème développeur

Cet incident met en exergue trois tendances majeures :

1. Les outils IA deviennent des cibles privilégiées

La généralisation des agents IA et solutions d’automatisation en fait un support idéal pour la diffusion de malwares.

2. L’exploitation de la confiance dans l’open source

Des plateformes telles que GitHub ou PyPI, bien que transparentes, peuvent être aisément exploitées par des attaquants.

3. Les crypto-actifs, des proies de choix

Les stealer malwares ciblent notamment :

- MetaMask

- Les portefeuilles intégrés aux navigateurs

- Les fichiers locaux de portefeuilles

- Les clés API

La récupération de ces actifs après compromission demeure exceptionnelle.

Guide utilisateur : se prémunir contre ces attaques

Face à la sophistication croissante des attaques, il est recommandé d’adopter les mesures suivantes :

1. Télécharger exclusivement depuis les sources officielles

Évitez tout téléchargement depuis les résultats de recherche ; privilégiez toujours le site officiel ou le GitHub du projet.

2. Vérifier les dépôts de code

Soyez attentif à :

- La présence d’une certification officielle

- Un historique de commits conséquent

- Une communauté de contributeurs active

3. Contrôler les signatures des installeurs

De nombreux projets de confiance fournissent des signatures SHA256 ou GPG.

4. Utiliser des appareils distincts pour la gestion des clés privées

Ne stockez jamais de clés privées de grande valeur dans l’environnement de développement.

5. Privilégier les portefeuilles matériels

Même en cas de compromission du poste, ils offrent une sécurité supérieure.

Défis de sécurité et perspectives à l’ère de la recherche IA

L’incident d’empoisonnement des résultats Bing AI met en évidence que les moteurs de recherche IA ne filtrent pas encore efficacement les contenus de confiance.

Avec l’essor de la recherche IA, des agents et outils d’automatisation, les attaquants perfectionnent leurs méthodes :

- Empoisonnement des résultats IA

- Génération de contenus malicieux par IA

- Injection de code malveillant dans les plugins d’agents IA

À l’avenir, les plateformes devront muscler leurs défenses, notamment en :

- Renforçant la vérification des sources dans les résultats IA

- Instaurant des systèmes de notation de confiance pour les dépôts open source

- Améliorant la détection automatique de malwares

Dans un environnement où outils IA et crypto-actifs sont indissociables, l’éducation à la sécurité restera la meilleure protection pour les actifs numériques.

Articles Connexes

Guide de prévention des arnaques Airdrop

Les 10 meilleurs outils de trading en Crypto

Qu'est-ce que Fartcoin ? Tout ce qu'il faut savoir sur FARTCOIN

Qu'est-ce que les récits Crypto? Top récits pour 2025 (MISE À JOUR)

La vérité sur la pièce PI : pourrait-elle être le prochain Bitcoin ?